搜索到

38

篇与

的结果

-

-

免费安防 LiteAIServer视频分析服务 对接接口 企业微信报警 行人入侵检测,烟火检测,工程车检测,玩手机打电话检测,厨帽检测,车辆检测,未戴安全帽检测,裸土检测,扬尘检测,固废检测,物料状态变化检测,工业排污检测,老鼠检测,不戴口罩检测、视频质量诊断等15种算法),实时分析、告警输出 LiteAIServer介绍https://www.easydarwin.org/tools/155.html概要功能概述:视频分析服务,支持多种视频分析算法(目前内置行人入侵检测,烟火检测,工程车检测,玩手机打电话检测,厨帽检测,车辆检测,未戴安全帽检测,裸土检测,扬尘检测,固废检测,物料状态变化检测,工业排污检测,老鼠检测,不戴口罩检测、视频质量诊断等15种算法),实时分析、告警输出操作系统:Windows、Linux、各种操作系统可定向编译适用场景:各行业下载地址:为了解决视频接入方式局限在RTSP协议的问题,LiteAIServer已经作为EasyGBS内置算法插件形式存在,可搭配EasyGBS接入RTSP/ONVIF/GB28181/RTMP等多种协议,具体可前往下载EasyGBS免费版(https://www.easygbs.com/)部署EasyGBShttps://www.easygbs.com/docs/down/EasyGBS%E4%B8%8B%E8%BD%BD软件解压即用,双击install.bat启动如出现端口占用,如深信服VPN占用10000修改配置文件 configs/config.toml# 对外提供的 http 服务 [Server.HTTP] # http 端口 Port = 10001启动程序登陆网页http://127.0.0.1:10001/配置账号密码部署LiteAIServer安装并启用LiteAIServer无需其他配置,登录即可LiteAiServer 默认服务地址:http://127.0.0.1:9800 默认账号:lnton 默认密码:lnton喇叭图标开启报警音配置通道示例宇视科技 rtsp://admin:12345@192.168.1.66:554/video1 大华股份 rtsp://admin:12345@192.168.1.65:554/cam/realmonitor?channel=1&subtype=0 海康威视 rtsp://admin:12345@192.168.1.64:554/h264/ch1/main/av_stream分别配置 算法设置 输出设置当声音开启时,就可以从浏览器接收到语音告警BUG处理1、通道编码、名称 一定不要带有中文,配置中文无法删除替换plugins\LiteAIServer\AIServer.db,恢复默认2、通道管理不工作通道管理二次修改后不会推送告警,需要重启服务EasyGBS-服务扩展-LiteAIServer 停用再启用报警协议http为post推送推送内容{ "type": "analyseResult", "token": "", "session": "", "Data": { "time": "2026-03-20 15:39:15", "chId": "223344", "pluginId": 11, "pluginName": "LNTON", "seq": 0, "errorCode": 0, "errorMsg": "", "result": { "ObjectNum": 1, "Objects": [ { "moduleId": 1, "moduleName": "行人入侵检测", "prob": 0.875617, "X": 1520, "Y": 189, "Width": 101, "Height": 247 } ], "ImageWidth": 1920, "ImageHeight": 1080, "ImageData": "Base64编码的JPEG图像......" } } }根据协议开发报警程序更多待续

免费安防 LiteAIServer视频分析服务 对接接口 企业微信报警 行人入侵检测,烟火检测,工程车检测,玩手机打电话检测,厨帽检测,车辆检测,未戴安全帽检测,裸土检测,扬尘检测,固废检测,物料状态变化检测,工业排污检测,老鼠检测,不戴口罩检测、视频质量诊断等15种算法),实时分析、告警输出 LiteAIServer介绍https://www.easydarwin.org/tools/155.html概要功能概述:视频分析服务,支持多种视频分析算法(目前内置行人入侵检测,烟火检测,工程车检测,玩手机打电话检测,厨帽检测,车辆检测,未戴安全帽检测,裸土检测,扬尘检测,固废检测,物料状态变化检测,工业排污检测,老鼠检测,不戴口罩检测、视频质量诊断等15种算法),实时分析、告警输出操作系统:Windows、Linux、各种操作系统可定向编译适用场景:各行业下载地址:为了解决视频接入方式局限在RTSP协议的问题,LiteAIServer已经作为EasyGBS内置算法插件形式存在,可搭配EasyGBS接入RTSP/ONVIF/GB28181/RTMP等多种协议,具体可前往下载EasyGBS免费版(https://www.easygbs.com/)部署EasyGBShttps://www.easygbs.com/docs/down/EasyGBS%E4%B8%8B%E8%BD%BD软件解压即用,双击install.bat启动如出现端口占用,如深信服VPN占用10000修改配置文件 configs/config.toml# 对外提供的 http 服务 [Server.HTTP] # http 端口 Port = 10001启动程序登陆网页http://127.0.0.1:10001/配置账号密码部署LiteAIServer安装并启用LiteAIServer无需其他配置,登录即可LiteAiServer 默认服务地址:http://127.0.0.1:9800 默认账号:lnton 默认密码:lnton喇叭图标开启报警音配置通道示例宇视科技 rtsp://admin:12345@192.168.1.66:554/video1 大华股份 rtsp://admin:12345@192.168.1.65:554/cam/realmonitor?channel=1&subtype=0 海康威视 rtsp://admin:12345@192.168.1.64:554/h264/ch1/main/av_stream分别配置 算法设置 输出设置当声音开启时,就可以从浏览器接收到语音告警BUG处理1、通道编码、名称 一定不要带有中文,配置中文无法删除替换plugins\LiteAIServer\AIServer.db,恢复默认2、通道管理不工作通道管理二次修改后不会推送告警,需要重启服务EasyGBS-服务扩展-LiteAIServer 停用再启用报警协议http为post推送推送内容{ "type": "analyseResult", "token": "", "session": "", "Data": { "time": "2026-03-20 15:39:15", "chId": "223344", "pluginId": 11, "pluginName": "LNTON", "seq": 0, "errorCode": 0, "errorMsg": "", "result": { "ObjectNum": 1, "Objects": [ { "moduleId": 1, "moduleName": "行人入侵检测", "prob": 0.875617, "X": 1520, "Y": 189, "Width": 101, "Height": 247 } ], "ImageWidth": 1920, "ImageHeight": 1080, "ImageData": "Base64编码的JPEG图像......" } } }根据协议开发报警程序更多待续 -

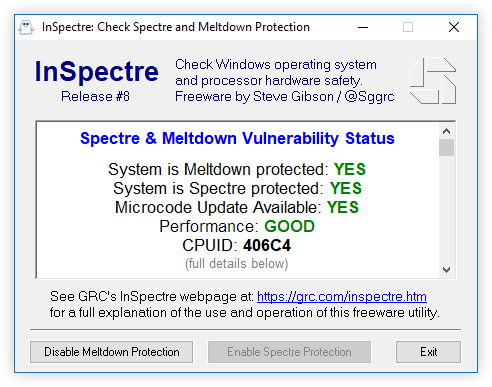

windows PC 服务器 域控使用技巧、经验记录 1、关闭“幽灵”和“熔断”漏洞防护可恢复部分性能,有风险:https://www.grc.com/inspectre.htm2、Chrome开启多线程下载在地址栏输入 chrome://flags/,然后在搜索框中输入 Parallel downloading,选择enabled,重启Chrome3、如何在 Windows 上查看 HEIC 格式照片?https://www.microsoft.com/en-us/p/heif-image-extensions/9pmmsr1cgpwg?activetab=pivot:overviewtab4、win10自动登陆账号打开“设置-账户-登录选项”;取消“需要通过Windows Hello登录Microsoft账户”前面的复选框;点击桌面左下角的搜索栏,输入“netplwiz”,然后右侧点击“以管理员身份运行”;取消“要使用本计算机,用户必须输入用户名和密码”前面的复选框,并根据提示输入正确的账号名和密码;5、关闭休眠文件使用管理员运行cmd,执行:powercfg -h off 6、win10企业版无法访问共享文件夹首先我们按“window R键”打开运行窗口。在该窗口文本输入处输入“gpedit.msc”,这样本地组策略编辑器就能被启动。进入编辑器页面后,找到并点击页面左侧列的“计算机配置”。4.接着点击计算机配置下的“管理模板”选项。然后在管理模板下,依次点开“网络”-“Lanman工作站”。打开“Lanman工作站”后,在页面右侧列找到“启用不安全的来宾登录”。7.双击该选项,并选择“已启用”,再点击“确定”即可。启动不安全的来宾登录7、WIN10 添加自动启动程序无效的解决方案将启动项目加入Hkey_local_machine\software\wow6432node\microsoft\windows\currentversion\run或放入开机启动目录 运行-shell:Common Startup8、WPS右键无新建doc、xls等快捷方式重置插件,重新注册9、使加域的计算机具备本地管理员权限使用本地管理员登录计算机,在本地管理员组中加入域用户10、win11右键管理员菜单样式j经典 reg add "HKCU\Software\Classes\CLSID\{86ca1aa0-34aa-4e8b-a509-50c905bae2a2}\InprocServer32" /f /ve x新版 reg delete "HKCU\Software\Classes\CLSID\{86ca1aa0-34aa-4e8b-a509-50c905bae2a2}" /f11、命令行禁用UACC:\Windows\System32\cmd.exe /k %windir%\System32\reg.exe ADD HKLM\SOFTWARE\Microsoft\Windows\CurrentVersion\Policies\System /v EnableLUA /t REG_DWORD /d 0 /f 0为禁用 1为默认12、win11任务栏展开https://github.com/valinet/ExplorerPatcher/releases13、windows查看wifi无线信号强度netsh wlan show interfaces14、解决FTP因windows防火墙拦截的方法防火墙放行 windows-system32-svchost.exe(windows服务主进程)15、windows远程桌面登录提示内部错误Error Code 0x4微软论坛搜索https://social.technet.microsoft.com/Forums/en-US/f7ed9049-36a5-4def-90f8-14ebb70e6671/error-code-0x4新建注册表项Computer\HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\Control\Terminal Server MaxOutstandingConnections DWORD 300016、一键修改远程桌面端口、开放防火墙、开启ping回显REG QUERY "HKEY_LOCAL_MACHINE\SYSTEM\ControlSet001\Control\Remote Assistance" /v "fAllowToGetHelp" reg add "HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\Control\Terminal Server\Wds\rdpwd\Tds\tcp" /v "PortNumber" /t REG_DWORD /d "0xf3b6" /f reg add "HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\Control\Terminal Server\WinStations\RDP-Tcp" /v "PortNumber" /t REG_DWORD /d "0xf3b6" /f net stop TermService /y net start TermService /y netsh advfirewall firewall add rule name="secrdp" dir=in action=allow protocol=TCP localport=62390 netsh advfirewall firewall add rule name="_Ping" dir=in protocol=icmpv4 action=allow17、配置windows计划任务运行 任务计划程序常规-不管用户是否登录等要运行常规-使用最高权限运行每天每2分钟运行一次触发器操作-启动程序设置-如果此任务已经运行,以下规则适用:停止现有实例18、windows重置SIDC:\Windows\System32\Sysprep勾选通用,等待重启即可19、.NET:这台计算机中已经安装了.net framework 4.8或更高的更新安装.NET Framework 4.8 开发者工具包https://dotnet.microsoft.com/zh-cn/download/visual-studio-sdks20、windows计算md5certutil -hashfile 文件 MD521、教你一个命令,几十秒钟给ltsc安装微软商店Storehttps://bbs.pcbeta.com/viewthread-1945054-1-1.html以管理员身份运行cmd执行wsreset -i22、域策略禁止软件运行用户配置—策略—管理模板—系统 “不运行指定的windows应用程序”

windows PC 服务器 域控使用技巧、经验记录 1、关闭“幽灵”和“熔断”漏洞防护可恢复部分性能,有风险:https://www.grc.com/inspectre.htm2、Chrome开启多线程下载在地址栏输入 chrome://flags/,然后在搜索框中输入 Parallel downloading,选择enabled,重启Chrome3、如何在 Windows 上查看 HEIC 格式照片?https://www.microsoft.com/en-us/p/heif-image-extensions/9pmmsr1cgpwg?activetab=pivot:overviewtab4、win10自动登陆账号打开“设置-账户-登录选项”;取消“需要通过Windows Hello登录Microsoft账户”前面的复选框;点击桌面左下角的搜索栏,输入“netplwiz”,然后右侧点击“以管理员身份运行”;取消“要使用本计算机,用户必须输入用户名和密码”前面的复选框,并根据提示输入正确的账号名和密码;5、关闭休眠文件使用管理员运行cmd,执行:powercfg -h off 6、win10企业版无法访问共享文件夹首先我们按“window R键”打开运行窗口。在该窗口文本输入处输入“gpedit.msc”,这样本地组策略编辑器就能被启动。进入编辑器页面后,找到并点击页面左侧列的“计算机配置”。4.接着点击计算机配置下的“管理模板”选项。然后在管理模板下,依次点开“网络”-“Lanman工作站”。打开“Lanman工作站”后,在页面右侧列找到“启用不安全的来宾登录”。7.双击该选项,并选择“已启用”,再点击“确定”即可。启动不安全的来宾登录7、WIN10 添加自动启动程序无效的解决方案将启动项目加入Hkey_local_machine\software\wow6432node\microsoft\windows\currentversion\run或放入开机启动目录 运行-shell:Common Startup8、WPS右键无新建doc、xls等快捷方式重置插件,重新注册9、使加域的计算机具备本地管理员权限使用本地管理员登录计算机,在本地管理员组中加入域用户10、win11右键管理员菜单样式j经典 reg add "HKCU\Software\Classes\CLSID\{86ca1aa0-34aa-4e8b-a509-50c905bae2a2}\InprocServer32" /f /ve x新版 reg delete "HKCU\Software\Classes\CLSID\{86ca1aa0-34aa-4e8b-a509-50c905bae2a2}" /f11、命令行禁用UACC:\Windows\System32\cmd.exe /k %windir%\System32\reg.exe ADD HKLM\SOFTWARE\Microsoft\Windows\CurrentVersion\Policies\System /v EnableLUA /t REG_DWORD /d 0 /f 0为禁用 1为默认12、win11任务栏展开https://github.com/valinet/ExplorerPatcher/releases13、windows查看wifi无线信号强度netsh wlan show interfaces14、解决FTP因windows防火墙拦截的方法防火墙放行 windows-system32-svchost.exe(windows服务主进程)15、windows远程桌面登录提示内部错误Error Code 0x4微软论坛搜索https://social.technet.microsoft.com/Forums/en-US/f7ed9049-36a5-4def-90f8-14ebb70e6671/error-code-0x4新建注册表项Computer\HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\Control\Terminal Server MaxOutstandingConnections DWORD 300016、一键修改远程桌面端口、开放防火墙、开启ping回显REG QUERY "HKEY_LOCAL_MACHINE\SYSTEM\ControlSet001\Control\Remote Assistance" /v "fAllowToGetHelp" reg add "HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\Control\Terminal Server\Wds\rdpwd\Tds\tcp" /v "PortNumber" /t REG_DWORD /d "0xf3b6" /f reg add "HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\Control\Terminal Server\WinStations\RDP-Tcp" /v "PortNumber" /t REG_DWORD /d "0xf3b6" /f net stop TermService /y net start TermService /y netsh advfirewall firewall add rule name="secrdp" dir=in action=allow protocol=TCP localport=62390 netsh advfirewall firewall add rule name="_Ping" dir=in protocol=icmpv4 action=allow17、配置windows计划任务运行 任务计划程序常规-不管用户是否登录等要运行常规-使用最高权限运行每天每2分钟运行一次触发器操作-启动程序设置-如果此任务已经运行,以下规则适用:停止现有实例18、windows重置SIDC:\Windows\System32\Sysprep勾选通用,等待重启即可19、.NET:这台计算机中已经安装了.net framework 4.8或更高的更新安装.NET Framework 4.8 开发者工具包https://dotnet.microsoft.com/zh-cn/download/visual-studio-sdks20、windows计算md5certutil -hashfile 文件 MD521、教你一个命令,几十秒钟给ltsc安装微软商店Storehttps://bbs.pcbeta.com/viewthread-1945054-1-1.html以管理员身份运行cmd执行wsreset -i22、域策略禁止软件运行用户配置—策略—管理模板—系统 “不运行指定的windows应用程序” -

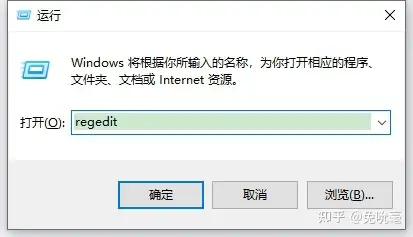

彻底清理window10、windows11、Edge浏览器微软用户邮箱绑定 参考链接https://www.zhihu.com/question/8239136687https://www.azurew.com/%e9%94%99%e8%af%af%e8%a7%a3%e5%86%b3/13462.html清除与administrator绑定的微软账号作者:兔吮毫链接:https://www.zhihu.com/question/8239136687/answer/67329291890来源:知乎著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。步骤一:打开注册表,快捷键Win+R 输入 regedit ,点确定打开注册表步骤二:按路径找到地址(可以复制到地址栏一键直达),将这里的邮箱文件夹右键删除计算机\HKEY_CURRENT_USER\SOFTWARE\Microsoft\IdentityCRL\UserExtendedProperties计算机\HKEY_USERS.DEFAULT\Software\Microsoft\IdentityCRL\StoredIdentities步骤三:删除后注销电脑,重新登陆,继续下一步。步骤四:Win+R 输入regedit,打开注册表,找到地址,将 IdentityCRL 文件夹右键删除计算机\HKEY_CURRENT_USER\SOFTWARE\Microsoft\IdentityCRL计算机\HKEY_USERS.DEFAULT\Software\Microsoft\IdentityCRL步骤五:注销电脑,重新登陆,进入设置账户,你可以看到删除出现了,它终于出现了至此,Administrator与微软的关系解绑了。步骤六:删除登录密码,登录选项-密码-更改-输入当前密码,新密码不写直接点完成清除Edge浏览器微软用户绑定当前用户下的edge浏览器用户数据。如我的当前用户为"administrator",位置应该是:"C:\Users\Administrator\AppData\Local\Microsoft\Edge"删除Edge目录和Edgexx开头的目录

彻底清理window10、windows11、Edge浏览器微软用户邮箱绑定 参考链接https://www.zhihu.com/question/8239136687https://www.azurew.com/%e9%94%99%e8%af%af%e8%a7%a3%e5%86%b3/13462.html清除与administrator绑定的微软账号作者:兔吮毫链接:https://www.zhihu.com/question/8239136687/answer/67329291890来源:知乎著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。步骤一:打开注册表,快捷键Win+R 输入 regedit ,点确定打开注册表步骤二:按路径找到地址(可以复制到地址栏一键直达),将这里的邮箱文件夹右键删除计算机\HKEY_CURRENT_USER\SOFTWARE\Microsoft\IdentityCRL\UserExtendedProperties计算机\HKEY_USERS.DEFAULT\Software\Microsoft\IdentityCRL\StoredIdentities步骤三:删除后注销电脑,重新登陆,继续下一步。步骤四:Win+R 输入regedit,打开注册表,找到地址,将 IdentityCRL 文件夹右键删除计算机\HKEY_CURRENT_USER\SOFTWARE\Microsoft\IdentityCRL计算机\HKEY_USERS.DEFAULT\Software\Microsoft\IdentityCRL步骤五:注销电脑,重新登陆,进入设置账户,你可以看到删除出现了,它终于出现了至此,Administrator与微软的关系解绑了。步骤六:删除登录密码,登录选项-密码-更改-输入当前密码,新密码不写直接点完成清除Edge浏览器微软用户绑定当前用户下的edge浏览器用户数据。如我的当前用户为"administrator",位置应该是:"C:\Users\Administrator\AppData\Local\Microsoft\Edge"删除Edge目录和Edgexx开头的目录 -

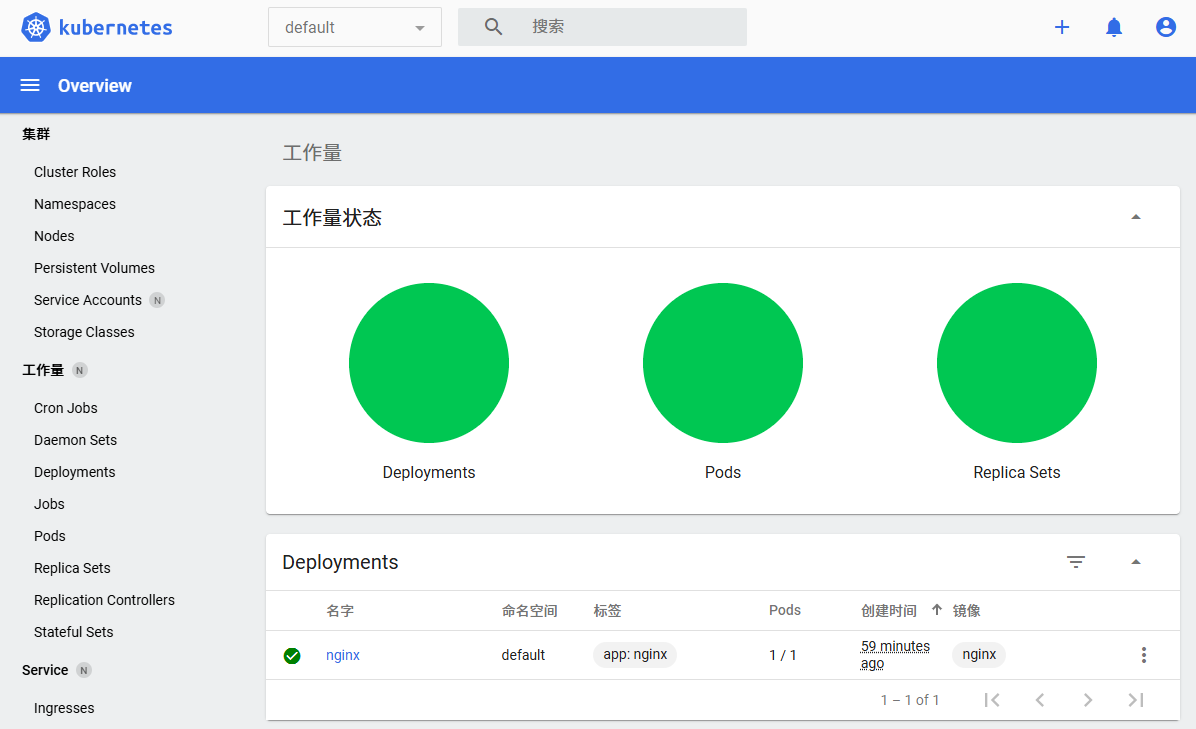

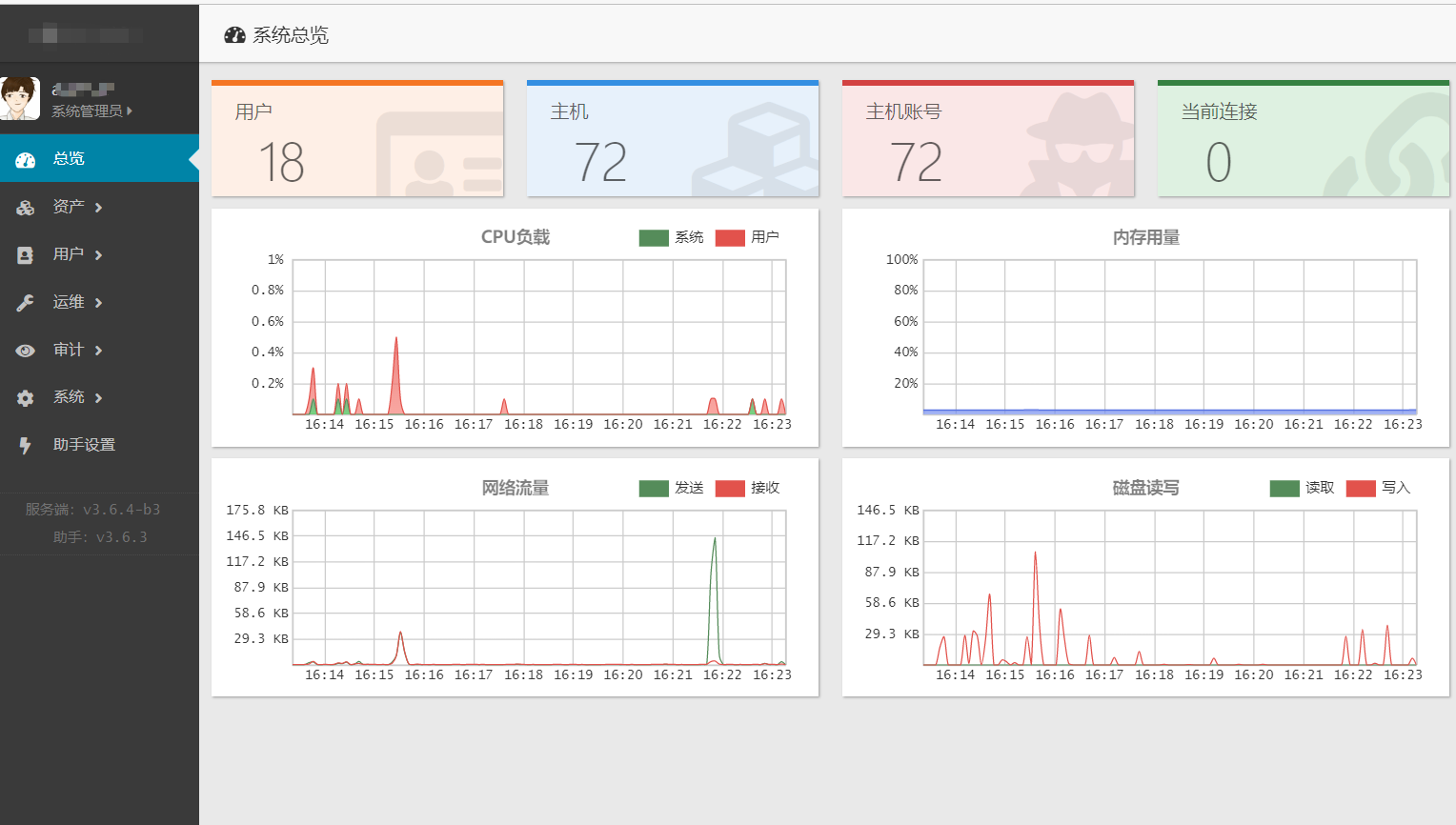

docker、K8S Kubernetes集群部署学习笔记 docker学习清华镜像源 yum install -y yum-utils sudo yum-config-manager --add-repo https://mirrors.tuna.tsinghua.edu.cn/docker-ce/linux/centos/docker-ce.repo sudo sed -i 's|https://download.docker.com|https://mirrors.tuna.tsinghua.edu.cn/docker-ce|g' /etc/yum.repos.d/docker-ce.repo 安装docker yum install docker-ce docker-ce-cli containerd.io systemctl enable --now docker 安装命令补全 yum install bash-completion -y 执行容器中的终端 docker exec -it 名称 bash docker run -d centos docker run -it -d nginx docker ps -a 查看所有容器,包含退出 -q 列出所有的容器ID docker rm -f 删除容器 映射端口、目录 docker run -d --name web -p 88:80 -v /opt/wwwroot/:/usr/share/nginx/html nginxFROM 构建新镜像是基于哪个镜像LABEL 标签RUN 构建镜像时运行的Shell命令COPY 拷贝文件或目录到镜像中ADD 解压压缩包并拷贝ENV 设置环境变量USER 为RUN、CMD和ENTRYPOINT执行命令指定运行用户EXPOSE 声明容器运行的服务端口WORKDIR 为RUN、CMD、ENTRYPOINT、COPY和ADD设置工作目录CMD 运行容器时默认执行,如果有多个CMD指令,最后一个生效docker编译docker build -t nginx:v1 .nginx镜像FROM centos:7 RUN curl -o /etc/yum.repos.d/CentOS-Base.repo https://mirrors.aliyun.com/repo/Centos-7.repo && \ yum install epel-release -y && \ yum install nginx -y CMD ["nginx","-g","daemon off;"]centos底包FROM centos:7 FROM centos:8 FROM almalinux:latest FROM almalinux/8-minimaltomcat镜像手动docker run -it -d alma:tnt docker exec -it 名称 bash dnf install java-openjdk -y dnf clean all rm -rf /var/cache/dnf/* curl -O https://mirrors.huaweicloud.com/apache/tomcat/tomcat-10/v10.1.33/bin/apache-tomcat-10.1.33.tar.gz tar xvzf apache-tomcat-10.1.33.tar.gz export TOMCAT_HOME=/apache-tomcat-10.1.33/ /apache-tomcat-10.1.33/bin/catalina.sh run创建dockerfileFROM almalinux:latest RUN dnf install java-openjdk -y &&\ dnf install java-openjdk -y &&\ dnf clean all &&\ rm -rf /var/cache/dnf/* RUN curl -O https://mirrors.huaweicloud.com/apache/tomcat/tomcat-10/v10.1.33/bin/apache-tomcat-10.1.33.tar.gz &&\ tar xvzf apache-tomcat-10.1.33.tar.gz &&\ export TOMCAT_HOME=/apache-tomcat-10.1.33/ &&\ rm -rf /apache-tomcat-10.1.33.tar.gz EXPOSE 8080 CMD ["/apache-tomcat-10.1.33/bin/catalina.sh","run"]编译运行docker build -t tomcat:tnt . docker run -d --name tomcattnt -p 8080:8080 tomcat:tntteleport堡垒机镜像手动docker run -it -d centos:7 docker exec -it 名称 bash curl -O https://tp4a.com/static/download/teleport-server-linux-x64-3.6.4-b3.tar.gz tar -zxvf teleport-server-linux-x64-3.6.4-b3.tar.gz rm -rf /teleport-server-linux-x64-3.6.4-b3.tar.gz mkdir /usr/local/teleport/data/assist -p cd /usr/local/teleport/data/assist curl -O https://tp4a.com/static/download/teleport-assist-windows-3.6.3.exe curl -O https://tp4a.com/static/download/teleport-assist-macos-3.6.3.dmg cd teleport-server-linux-x64-3.6.4-b3 sh -c '/bin/echo -e "\n" | sh ./setup.sh' sed -i 's/exit $shell_ret/\/usr\/bin\/tail -f \/usr\/local\/teleport\/data\/log\/tpcore.log/g' /usr/local/teleport/start.shdockerfile文件 teleportV3FROM centos:7 RUN curl -O https://tp4a.com/static/download/teleport-server-linux-x64-3.6.4-b3.tar.gz &&\ tar -zxvf teleport-server-linux-x64-3.6.4-b3.tar.gz &&\ rm -rf /teleport-server-linux-x64-3.6.4-b3.tar.gz &&\ mkdir /usr/local/teleport/data/assist -p &&\ cd /usr/local/teleport/data/assist &&\ curl -O https://tp4a.com/static/download/teleport-assist-windows-3.6.3.exe &&\ curl -O https://tp4a.com/static/download/teleport-assist-macos-3.6.3.dmg &&\ cd /teleport-server-linux-x64-3.6.4-b3 &&\ sh -c '/bin/echo -e "\n" | sh ./setup.sh' &&\ sed -i 's/exit $shell_ret/\/usr\/bin\/tail -f \/usr\/local\/teleport\/data\/log\/tpcore.log/g' /usr/local/teleport/start.sh &&\ rm -rf /teleport-server-linux-x64-3.6.4-b3 EXPOSE 7190 52089 52189 52389 CMD ["/etc/init.d/teleport","start"]编译运行docker build -t teleportv3:tnt . docker run -d --name teleportv3 -p 7190:7190 -p 52089:52089 -p 52189:52189 -p 52389:52389 teleportv3:tnt安装harbor下载解压harbor-online-installer-v2.11.2.tgz进入目录 cd /harbor 创建配置 cp harbor.yml.tmpl harbor.yml hostname: http: port:预配置./prepare部署./install.sh查看状态docker-compose ps关闭docker-compose stop启动docker-compose start后台运行docker-compose up -d删除harbor docker-compose down默认账号密码admin Harbor12345docker主机添加Harbor仓库{ "registry-mirrors": [ "https://docker.1panel.live" ], "insecure-registries" : ["10.100.0.1"] }查看docker配置是否成功docker info登录harbordocker login IP修改镜像tagdocker tag teleportv3:tnt 10.100.0.2/library/teleportv3:tnt推送docker push 10.100.0.2/library/teleportv3:tnt拉取镜像10.100.0.2/library/teleportv3:tnt{lamp/}K8S快速部署1、主机规划testk8s-master 192.168.4.10 testk8s-node1 192.168.4.11 testk8s-node2 192.168.4.12系统配置为4C8G200G,centos7系统,分区为/boot、/,无SWAP分区2、操作系统初始化-所有节点关闭防火墙systemctl stop firewalld systemctl disable firewalld关闭selinuxsed -i 's/enforcing/disabled/' /etc/selinux/config setenforce 0关闭swapswapoff -a # 临时 sed -ri 's/.*swap.*/#&/' /etc/fstab # 永久在master节点添加hostscat >> /etc/hosts << EOF 192.168.4.10 testk8s-master 192.168.4.11 testk8s-node1 192.168.4.12 testk8s-node2 EOF将桥接的IPv4流量传递到iptables的链cat > /etc/sysctl.d/k8s.conf << EOF net.bridge.bridge-nf-call-ip6tables = 1 net.bridge.bridge-nf-call-iptables = 1 EOF sysctl --system # 生效时间同步vi /etc/chrony.conf 增加 server 114.115.116.117 iburst systemctl restart chronyd 立即同步时间 chronyc -a makestep 查看同步状态 chronyc tracking 3、安装docker配置阿里云、清华镜像源curl -o /etc/yum.repos.d/CentOS-Base.repo https://mirrors.aliyun.com/repo/Centos-7.repo yum install -y yum-utils sudo yum-config-manager --add-repo https://mirrors.tuna.tsinghua.edu.cn/docker-ce/linux/centos/docker-ce.repo sudo sed -i 's|https://download.docker.com|https://mirrors.tuna.tsinghua.edu.cn/docker-ce|g' /etc/yum.repos.d/docker-ce.repo yum clean all yum makecache yum install bash-completion -y yum install docker-ce -y --nogpgcheck systemctl enable docker && systemctl start docker systemctl restart docker docker info4、安装vmtoolsyum install open-vm-tools -y5、做快照防止操作错误6、安装kubeadm,kubelet和kubectl配置镜像加速镜像源列表https://www.cnblogs.com/gnuorg/p/18570325cat > /etc/docker/daemon.json << EOF { "registry-mirrors": ["https://docker.1panel.live"] } EOF systemctl restart docker cat > /etc/yum.repos.d/kubernetes.repo << EOF [kubernetes] name=Kubernetes baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64 enabled=1 gpgcheck=0 repo_gpgcheck=0 gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg EOF 指定版本号yum install -y kubelet-1.20.0 kubeadm-1.20.0 kubectl-1.20.0 systemctl enable kubelet7、部署Kubernetes Master在192.168.4.10(Master)执行。kubeadm init \ --apiserver-advertise-address=192.168.4.10 \ --image-repository registry.aliyuncs.com/google_containers \ --kubernetes-version v1.20.0 \ --service-cidr=10.96.0.0/12 \ --pod-network-cidr=10.244.0.0/16 \ --ignore-preflight-errors=all 解释 --apiserver-advertise-address 集群通告地址 --image-repository 由于默认拉取镜像地址k8s.gcr.io国内无法访问,这里指定阿里云镜像仓库地址 --kubernetes-version K8s版本,与上面安装的一致 --service-cidr 集群内部虚拟网络,Pod统一访问入口 --pod-network-cidr Pod网络,与下面部署的CNI网络组件yaml中保持一致 --ignore-preflight-errors=all 忽略错误 初始化完成后,最后会输出一个join命令,先记住,下面用。执行后返回Then you can join any number of worker nodes by running the following on each as root: kubeadm join 192.168.4.10:6443 --token oweerb.nonsh3zl5a8no0od \ --discovery-token-ca-cert-hash sha256:279352b82d65dd6bd470ea1b8c54542215696402a0d6bd8a20e53102f39f8a21 拷贝kubectl使用的连接k8s认证文件到默认路径 mkdir -p $HOME/.kube sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config sudo chown $(id -u):$(id -g) $HOME/.kube/config查看工作节点kubectl get nodes NAME STATUS ROLES AGE VERSION testk8s-master NotReady control-plane,master 104s v1.20.08、加入K8S node在Node节点执行192.168.4.11192.168.4.12向集群添加新节点,执行在kubeadm init输出的kubeadm join命令kubeadm join 192.168.4.10:6443 --token oweerb.nonsh3zl5a8no0od \ --discovery-token-ca-cert-hash sha256:279352b82d65dd6bd470ea1b8c54542215696402a0d6bd8a20e53102f39f8a21默认token有效期为24小时,当过期之后,该token就不可用了。这时就需要重新创建token,可以直接使用命令快捷生成kubeadm token create --print-join-command查看工作节点kubectl get nodes NAME STATUS ROLES AGE VERSION testk8s-master NotReady control-plane,master 3m42s v1.20.0 testk8s-node1 NotReady <none> 19s v1.20.0 testk8s-node2 NotReady <none> 16s v1.20.09、部署容器网络(CNI)Calico是一个纯三层的数据中心网络方案,是目前Kubernetes主流的网络方案。下载YAMLcurl https://docs.projectcalico.org/v3.20/manifests/calico.yaml -O下载完后还需要修改里面定义Pod网络(CALICO_IPV4POOL_CIDR),与前面kubeadm init的 --pod-network-cidr指定的一样。# The default IPv4 pool to create on startup if none exists. Pod IPs will be # chosen from this range. Changing this value after installation will have # no effect. This should fall within `--cluster-cidr`. - name: CALICO_IPV4POOL_CIDR value: "10.244.0.0/16"修改完后文件后,部署:kubectl apply -f calico.yaml kubectl get pods -n kube-system等Calico Pod都Running,节点也会准备就绪。注:以后所有yaml文件都只在Master节点执行!安装目录:/etc/kubernetes/组件配置文件目录:/etc/kubernetes/manifests/节点运行情况 kubectl get pods -n kube-system NAME READY STATUS RESTARTS AGE calico-kube-controllers-577f77cb5c-jrcfs 0/1 Pending 0 5s calico-node-fznrr 0/1 Init:0/3 0 6s calico-node-nrrwj 0/1 Init:0/3 0 6s calico-node-x7hds 0/1 Init:0/3 0 6s coredns-7f89b7bc75-6lr2s 0/1 Pending 0 7m18s coredns-7f89b7bc75-kwq9c 0/1 Pending 0 7m18s etcd-testk8s-master 1/1 Running 0 7m26s kube-apiserver-testk8s-master 1/1 Running 0 7m26s kube-controller-manager-testk8s-master 1/1 Running 0 7m26s kube-proxy-6pbwh 1/1 Running 0 4m9s kube-proxy-btgsz 1/1 Running 0 4m12s kube-proxy-cdfxc 1/1 Running 0 7m18s kube-scheduler-testk8s-master 1/1 Running 0 7m26s 会出现的一种情况是镜像下载失败calico-node-fznrr 0/1 Init:ImagePullBackOff 0 5m32s calico-node-nrrwj 0/1 Init:ImagePullBackOff 0 5m32s calico-node-x7hds 0/1 Init:ImagePullBackOff 0 5m32s 查看失败原因 kubectl describe po calico-node-fznrr -n kube-system Warning Failed 2m11s kubelet Failed to pull image "docker.io/calico/pod2daemon-flexvol:v3.20.6": rpc error: code = Unknown desc = Error response from daemon: Get "https://registry-1.docker.io/v2/": net/http: request canceled while waiting for connection (Client.Timeout exceeded while awaiting headers) Warning Failed 2m11s kubelet Error: ErrImagePull Normal BackOff 2m11s kubelet Back-off pulling image "docker.io/calico/pod2daemon-flexvol:v3.20.6" Warning Failed 2m11s kubelet Error: ImagePullBackOff Normal Pulling 116s (x2 over 5m31s) kubelet Pulling image "docker.io/calico/pod2daemon-flexvol:v3.20.6" 通过镜像站点下载 https://docker.aityp.com/image/docker.io/calico/pod2daemon-flexvol:v3.20.6docker pull swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/calico/pod2daemon-flexvol:v3.20.6 docker tag swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/calico/pod2daemon-flexvol:v3.20.6 docker.io/calico/pod2daemon-flexvol:v3.20.6 等待自动修复完成calico-kube-controllers-577f77cb5c-jrcfs 0/1 ContainerCreating 0 22m calico-node-fznrr 0/1 Running 0 22m calico-node-nrrwj 1/1 Running 0 22m calico-node-x7hds 1/1 Running 0 22m 有时发生错误,重启k8s也能解决systemctl restart kubelet创建pod测试kubectl create deployment nginx --image=nginx查看pod状态kubectl get pod查看pod状态带节点和IPkubectl get pod -o wide NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES nginx-6799fc88d8-rqb82 1/1 Running 0 14m 10.244.236.3 testk8s-node1 <none> <none> 测试nginxcurl 10.244.236.3 <!DOCTYPE html> <html> <head> <title>Welcome to nginx!</title> 创建外部访问kubectl expose deployment nginx --port=80 --target-port=80 --type=NodePort查看外部端口 范围 30000以上kubectl get pod,svc NAME READY STATUS RESTARTS AGE pod/nginx-6799fc88d8-rqb82 1/1 Running 0 15m NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE service/kubernetes ClusterIP 10.96.0.1 <none> 443/TCP 46m service/nginx NodePort 10.101.228.228 <none> 80:32507/TCP 15s访问地址为http://192.168.4.11:32507/ http://192.168.4.12:32507/即Pod任意节点IP,组合service映射的端口10、部署dashboardYAML下载地址curl https://raw.githubusercontent.com/kubernetes/dashboard/v2.0.3/aio/deploy/recommended.yaml -O修改yaml,增加nodePort: 30001 type: NodePortkind: Service apiVersion: v1 metadata: labels: k8s-app: kubernetes-dashboard name: kubernetes-dashboard namespace: kubernetes-dashboard spec: type: NodePort ports: - port: 443 targetPort: 8443 nodePort: 30001 selector: k8s-app: kubernetes-dashboard部署dashboardkubectl apply -f recommended.yaml查看状态kubectl get pods -n kubernetes-dashboard创建service account并绑定默认cluster-admin管理员集群角色:创建用户kubectl create serviceaccount dashboard-admin -n kube-system用户授权kubectl create clusterrolebinding dashboard-admin --clusterrole=cluster-admin --serviceaccount=kube-system:dashboard-admin获取用户Tokenkubectl describe secrets -n kube-system $(kubectl -n kube-system get secret | awk '/dashboard-admin/ {print $1}') Name: dashboard-admin-token-sqtsm Namespace: kube-system Labels: <none> Annotations: kubernetes.io/service-account.name: dashboard-admin kubernetes.io/service-account.uid: 77ad4c5d-e4e0-4dc9-b014-7f679acf5aff Type: kubernetes.io/service-account-token Data ==== ca.crt: 1066 bytes namespace: 11 bytes token: eyJhbGciOiJSUzI1NiIsImtpZCI6InY0U0pqNDh2M0ZGMVdMTGdxSnNBcmxMaVFGVE9nMC1tMnhxQzFfZjF3aEUifQ.eyJpc3MiOiJrdWJlcm5ldGVzL3NlcnZpY2VhY2NvdW50Iiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9uYW1lc3BhY2UiOiJrdWJlLXN5c3RlbSIsImt1YmVybmV0ZXMuaW8vc2VydmljZWFjY291bnQvc2VjcmV0Lm5hbWUiOiJkYXNoYm9hcmQtYWRtaW4tdG9rZW4tc3F0c20iLCJrdWJlcm5ldGVzLmlvL3NlcnZpY2VhY2NvdW50L3NlcnZpY2UtYWNjb3VudC5uYW1lIjoiZGFzaGJvYXJkLWFkbWluIiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9zZXJ2aWNlLWFjY291bnQudWlkIjoiNzdhZDRjNWQtZTRlMC00ZGM5LWIwMTQtN2Y2NzlhY2Y1YWZmIiwic3ViIjoic3lzdGVtOnNlcnZpY2VhY2NvdW50Omt1YmUtc3lzdGVtOmRhc2hib2FyZC1hZG1pbiJ9.fwivtHsitw0ABTfb96HqIJ6N9SL23eiZtIjniqB1qRYIODkGJkOXKGpUmEXPRwR-pQr4glk1KDP9dB2xidET9IhZ-3iKt_5K8xb9K3aELG9yOzzH0Xmi88SaY6A6ZrABaCjjTcp80d-5FgQhRB6ruMLnD1N7vftYk1Sf37HvZ_bKApq1C6uebKnMd0M2EcPckjepvSXmD6fdsosTAJrTYeEpcFCjR6IS5R9bnrN7ADwFZHu-kEekhhV7g888REdhnbSkAvzE9OYbIf7uVgTkh6C_ZhJEzODViHS_RDkiEbZSqs0Q53h50CgL8tj3CBrkV9FvO7SoKVCtvTkYZyPfcQ 访问地址:https://NodeIP:30001任何节点都可以访问https://192.168.4.10:30001/ https://192.168.4.11:30001/EDGE访问出现你的连接不是专用链接,没有继续访问按钮时解决办法保持焦点在页面内,鼠标在页面空白处点击(不选中任何按钮),直接输入“thisisunsafe”,输完后按回车键,就可以正常访问网页。这里要注意的是,输入的时候页面时不会有任何反应的,也不会显示输入的字符,是正常现象。输入完毕后点回车即可。输入Token登录token: eyJhbGciOiJSUzI1NiIsImtpZCI6InY0U0pqNDh2M0ZGMVdMTGdxSnNBcmxMaVFGVE9nMC1tMnhxQzFfZjF3aEUifQ.eyJpc3MiOiJrdWJlcm5ldGVzL3NlcnZpY2VhY2NvdW50Iiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9uYW1lc3BhY2UiOiJrdWJlLXN5c3RlbSIsImt1YmVybmV0ZXMuaW8vc2VydmljZWFjY291bnQvc2VjcmV0Lm5hbWUiOiJkYXNoYm9hcmQtYWRtaW4tdG9rZW4tc3F0c20iLCJrdWJlcm5ldGVzLmlvL3NlcnZpY2VhY2NvdW50L3NlcnZpY2UtYWNjb3VudC5uYW1lIjoiZGFzaGJvYXJkLWFkbWluIiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9zZXJ2aWNlLWFjY291bnQudWlkIjoiNzdhZDRjNWQtZTRlMC00ZGM5LWIwMTQtN2Y2NzlhY2Y1YWZmIiwic3ViIjoic3lzdGVtOnNlcnZpY2VhY2NvdW50Omt1YmUtc3lzdGVtOmRhc2hib2FyZC1hZG1pbiJ9.fwivtHsitw0ABTfb96HqIJ6N9SL23eiZtIjniqB1qRYIODkGJkOXKGpUmEXPRwR-pQr4glk1KDP9dB2xidET9IhZ-3iKt_5K8xb9K3aELG9yOzzH0Xmi88SaY6A6ZrABaCjjTcp80d-5FgQhRB6ruMLnD1N7vftYk1Sf37HvZ_bKApq1C6uebKnMd0M2EcPckjepvSXmD6fdsosTAJrTYeEpcFCjR6IS5R9bnrN7ADwFZHu-kEekhhV7g888REdhnbSkAvzE9OYbIf7uVgTkh6C_ZhJEzODViHS_RDkiEbZSqs0Q53h50CgL8tj3CBrkV9FvO7SoKVCtvTkYZyPfcQ11、查看日志查看容器日志kubectl logs 容器名称 -n kube-system kubectl get pod NAME READY STATUS RESTARTS AGE nginx-6799fc88d8-rqb82 1/1 Running 0 37m kubectl logs nginx-6799fc88d8-rqb82 /docker-entrypoint.sh: /docker-entrypoint.d/ is not empty, will attempt to perform configuration /docker-entrypoint.sh: Looking for shell scripts in /docker-entrypoint.d/ /docker-entrypoint.sh: Launching /docker-entrypoint.d/10-listen-on-ipv6-by-default.sh查看容器事件kubectl describe pod 容器名称 -n kube-system kubectl describe pod nginx-6799fc88d8-rqb82 Name: nginx-6799fc88d8-rqb82 Namespace: default Priority: 0 Node: testk8s-node1/192.168.4.11 Start Time: Wed, 22 Oct 2025 14:17:29 +0800 Labels: app=nginx pod-template-hash=6799fc88d8查看calico.yaml所需要的镜像 grep image calico.yaml image: docker.io/calico/cni:v3.20.6 image: docker.io/calico/cni:v3.20.6 image: docker.io/calico/pod2daemon-flexvol:v3.20.6 image: docker.io/calico/node:v3.20.6 image: docker.io/calico/kube-controllers:v3.20.6 cailco镜像下载失败时解决办法通过镜像站下载 https://docker.aityp.com/清空部署环境kubeadm reset系统命令补全 yum install bash-completion -y{lamp/}扩展学习docker切换containerd1、先决条件节点执行 cat <<EOF | tee /etc/modules-load.d/containerd.conf overlay br_netfilter EOF modprobe overlay modprobe br_netfilter 设置内核参数 cat <<EOF | tee /etc/sysctl.d/99-kubernetes-cri.conf net.bridge.bridge-nf-call-iptables = 1 net.ipv4.ip_forward = 1 net.bridge.bridge-nf-call-ip6tables = 1 EOF 生效内核参数 sysctl --system2、安装containerd 节点执行安装依赖包yum install -y yum-utils device-mapper-persistent-data lvm2安装docker仓库更新系统、安装containerdyum update -y yum install -y containerd.io配置containerd创建配置目录 mkdir -p /etc/containerd 创建默认配置文件 containerd config default | sudo tee /etc/containerd/config.toml重启containerdsystemctl restart containerd修改配置文件vi /etc/containerd/config.toml sandbox_image = "registry.k8s.io/pause:3.6" 修改为 registry.aliyuncs.com/google_containers/pause:3.2 SystemdCgroup = false 修改为 SystemdCgroup = true [plugins."io.containerd.grpc.v1.cri".registry.mirrors] 下增加两行 [plugins."io.containerd.grpc.v1.cri".registry.mirrors."docker.io"] endpoint = ["https://docker.xuanyuan.me/"] 对接kubeletvi /etc/sysconfig/kubelet KUBELET_EXTRA_ARGS=--container-runtime=remote --container-runtime-endpoint=unix:///run/containerd/containerd.sock --cgroup-driver=systemd停止dockersystemctl stop docker.socket&&systemctl stop docker && systemctl disable docker3、替换容器引擎master查看K8S状态kubectl get node NAME STATUS ROLES AGE VERSION k8s-master Ready control-plane,master 25h v1.20.0 k8s-node1 NotReady <none> 25h v1.20.0 k8s-node2 Ready <none> 25h v1.20.0节点重启kubeletsystemctl restart kubelet稍后master再次查看K8S状态kubectl get node NAME STATUS ROLES AGE VERSION k8s-master Ready control-plane,master 25h v1.20.0 k8s-node1 Ready <none> 25h v1.20.0 k8s-node2 Ready <none> 25h v1.20.0mater查看详细节点信息kubectl get node -o wide NAME STATUS ROLES AGE VERSION INTERNAL-IP EXTERNAL-IP OS-IMAGE KERNEL-VERSION CONTAINER-RUNTIME k8s-master Ready control-plane,master 25h v1.20.0 192.168.4.10 <none> CentOS Linux 7 (Core) 3.10.0-1160.el7.x86_64 docker://26.1.4 k8s-node1 Ready <none> 25h v1.20.0 192.168.4.11 <none> CentOS Linux 7 (Core) 3.10.0-1160.el7.x86_64 containerd://1.6.33 k8s-node2 Ready <none> 25h v1.20.0 192.168.4.12 <none> CentOS Linux 7 (Core) 3.10.0-1160.el7.x86_64 docker://26.1.4更多K8S命令查看master组件状态kubectl get cs查看k8s所有资源kubectl api-resources查看node状态kubectl get node 查看APIserver代理的URLkubectl cluster-info查看集群详细信息kubectl cluster-info dump查看资源信息kubectl describe pod 名称 查看事件 kubectl get pods --watch 实时查看pod

docker、K8S Kubernetes集群部署学习笔记 docker学习清华镜像源 yum install -y yum-utils sudo yum-config-manager --add-repo https://mirrors.tuna.tsinghua.edu.cn/docker-ce/linux/centos/docker-ce.repo sudo sed -i 's|https://download.docker.com|https://mirrors.tuna.tsinghua.edu.cn/docker-ce|g' /etc/yum.repos.d/docker-ce.repo 安装docker yum install docker-ce docker-ce-cli containerd.io systemctl enable --now docker 安装命令补全 yum install bash-completion -y 执行容器中的终端 docker exec -it 名称 bash docker run -d centos docker run -it -d nginx docker ps -a 查看所有容器,包含退出 -q 列出所有的容器ID docker rm -f 删除容器 映射端口、目录 docker run -d --name web -p 88:80 -v /opt/wwwroot/:/usr/share/nginx/html nginxFROM 构建新镜像是基于哪个镜像LABEL 标签RUN 构建镜像时运行的Shell命令COPY 拷贝文件或目录到镜像中ADD 解压压缩包并拷贝ENV 设置环境变量USER 为RUN、CMD和ENTRYPOINT执行命令指定运行用户EXPOSE 声明容器运行的服务端口WORKDIR 为RUN、CMD、ENTRYPOINT、COPY和ADD设置工作目录CMD 运行容器时默认执行,如果有多个CMD指令,最后一个生效docker编译docker build -t nginx:v1 .nginx镜像FROM centos:7 RUN curl -o /etc/yum.repos.d/CentOS-Base.repo https://mirrors.aliyun.com/repo/Centos-7.repo && \ yum install epel-release -y && \ yum install nginx -y CMD ["nginx","-g","daemon off;"]centos底包FROM centos:7 FROM centos:8 FROM almalinux:latest FROM almalinux/8-minimaltomcat镜像手动docker run -it -d alma:tnt docker exec -it 名称 bash dnf install java-openjdk -y dnf clean all rm -rf /var/cache/dnf/* curl -O https://mirrors.huaweicloud.com/apache/tomcat/tomcat-10/v10.1.33/bin/apache-tomcat-10.1.33.tar.gz tar xvzf apache-tomcat-10.1.33.tar.gz export TOMCAT_HOME=/apache-tomcat-10.1.33/ /apache-tomcat-10.1.33/bin/catalina.sh run创建dockerfileFROM almalinux:latest RUN dnf install java-openjdk -y &&\ dnf install java-openjdk -y &&\ dnf clean all &&\ rm -rf /var/cache/dnf/* RUN curl -O https://mirrors.huaweicloud.com/apache/tomcat/tomcat-10/v10.1.33/bin/apache-tomcat-10.1.33.tar.gz &&\ tar xvzf apache-tomcat-10.1.33.tar.gz &&\ export TOMCAT_HOME=/apache-tomcat-10.1.33/ &&\ rm -rf /apache-tomcat-10.1.33.tar.gz EXPOSE 8080 CMD ["/apache-tomcat-10.1.33/bin/catalina.sh","run"]编译运行docker build -t tomcat:tnt . docker run -d --name tomcattnt -p 8080:8080 tomcat:tntteleport堡垒机镜像手动docker run -it -d centos:7 docker exec -it 名称 bash curl -O https://tp4a.com/static/download/teleport-server-linux-x64-3.6.4-b3.tar.gz tar -zxvf teleport-server-linux-x64-3.6.4-b3.tar.gz rm -rf /teleport-server-linux-x64-3.6.4-b3.tar.gz mkdir /usr/local/teleport/data/assist -p cd /usr/local/teleport/data/assist curl -O https://tp4a.com/static/download/teleport-assist-windows-3.6.3.exe curl -O https://tp4a.com/static/download/teleport-assist-macos-3.6.3.dmg cd teleport-server-linux-x64-3.6.4-b3 sh -c '/bin/echo -e "\n" | sh ./setup.sh' sed -i 's/exit $shell_ret/\/usr\/bin\/tail -f \/usr\/local\/teleport\/data\/log\/tpcore.log/g' /usr/local/teleport/start.shdockerfile文件 teleportV3FROM centos:7 RUN curl -O https://tp4a.com/static/download/teleport-server-linux-x64-3.6.4-b3.tar.gz &&\ tar -zxvf teleport-server-linux-x64-3.6.4-b3.tar.gz &&\ rm -rf /teleport-server-linux-x64-3.6.4-b3.tar.gz &&\ mkdir /usr/local/teleport/data/assist -p &&\ cd /usr/local/teleport/data/assist &&\ curl -O https://tp4a.com/static/download/teleport-assist-windows-3.6.3.exe &&\ curl -O https://tp4a.com/static/download/teleport-assist-macos-3.6.3.dmg &&\ cd /teleport-server-linux-x64-3.6.4-b3 &&\ sh -c '/bin/echo -e "\n" | sh ./setup.sh' &&\ sed -i 's/exit $shell_ret/\/usr\/bin\/tail -f \/usr\/local\/teleport\/data\/log\/tpcore.log/g' /usr/local/teleport/start.sh &&\ rm -rf /teleport-server-linux-x64-3.6.4-b3 EXPOSE 7190 52089 52189 52389 CMD ["/etc/init.d/teleport","start"]编译运行docker build -t teleportv3:tnt . docker run -d --name teleportv3 -p 7190:7190 -p 52089:52089 -p 52189:52189 -p 52389:52389 teleportv3:tnt安装harbor下载解压harbor-online-installer-v2.11.2.tgz进入目录 cd /harbor 创建配置 cp harbor.yml.tmpl harbor.yml hostname: http: port:预配置./prepare部署./install.sh查看状态docker-compose ps关闭docker-compose stop启动docker-compose start后台运行docker-compose up -d删除harbor docker-compose down默认账号密码admin Harbor12345docker主机添加Harbor仓库{ "registry-mirrors": [ "https://docker.1panel.live" ], "insecure-registries" : ["10.100.0.1"] }查看docker配置是否成功docker info登录harbordocker login IP修改镜像tagdocker tag teleportv3:tnt 10.100.0.2/library/teleportv3:tnt推送docker push 10.100.0.2/library/teleportv3:tnt拉取镜像10.100.0.2/library/teleportv3:tnt{lamp/}K8S快速部署1、主机规划testk8s-master 192.168.4.10 testk8s-node1 192.168.4.11 testk8s-node2 192.168.4.12系统配置为4C8G200G,centos7系统,分区为/boot、/,无SWAP分区2、操作系统初始化-所有节点关闭防火墙systemctl stop firewalld systemctl disable firewalld关闭selinuxsed -i 's/enforcing/disabled/' /etc/selinux/config setenforce 0关闭swapswapoff -a # 临时 sed -ri 's/.*swap.*/#&/' /etc/fstab # 永久在master节点添加hostscat >> /etc/hosts << EOF 192.168.4.10 testk8s-master 192.168.4.11 testk8s-node1 192.168.4.12 testk8s-node2 EOF将桥接的IPv4流量传递到iptables的链cat > /etc/sysctl.d/k8s.conf << EOF net.bridge.bridge-nf-call-ip6tables = 1 net.bridge.bridge-nf-call-iptables = 1 EOF sysctl --system # 生效时间同步vi /etc/chrony.conf 增加 server 114.115.116.117 iburst systemctl restart chronyd 立即同步时间 chronyc -a makestep 查看同步状态 chronyc tracking 3、安装docker配置阿里云、清华镜像源curl -o /etc/yum.repos.d/CentOS-Base.repo https://mirrors.aliyun.com/repo/Centos-7.repo yum install -y yum-utils sudo yum-config-manager --add-repo https://mirrors.tuna.tsinghua.edu.cn/docker-ce/linux/centos/docker-ce.repo sudo sed -i 's|https://download.docker.com|https://mirrors.tuna.tsinghua.edu.cn/docker-ce|g' /etc/yum.repos.d/docker-ce.repo yum clean all yum makecache yum install bash-completion -y yum install docker-ce -y --nogpgcheck systemctl enable docker && systemctl start docker systemctl restart docker docker info4、安装vmtoolsyum install open-vm-tools -y5、做快照防止操作错误6、安装kubeadm,kubelet和kubectl配置镜像加速镜像源列表https://www.cnblogs.com/gnuorg/p/18570325cat > /etc/docker/daemon.json << EOF { "registry-mirrors": ["https://docker.1panel.live"] } EOF systemctl restart docker cat > /etc/yum.repos.d/kubernetes.repo << EOF [kubernetes] name=Kubernetes baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64 enabled=1 gpgcheck=0 repo_gpgcheck=0 gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg EOF 指定版本号yum install -y kubelet-1.20.0 kubeadm-1.20.0 kubectl-1.20.0 systemctl enable kubelet7、部署Kubernetes Master在192.168.4.10(Master)执行。kubeadm init \ --apiserver-advertise-address=192.168.4.10 \ --image-repository registry.aliyuncs.com/google_containers \ --kubernetes-version v1.20.0 \ --service-cidr=10.96.0.0/12 \ --pod-network-cidr=10.244.0.0/16 \ --ignore-preflight-errors=all 解释 --apiserver-advertise-address 集群通告地址 --image-repository 由于默认拉取镜像地址k8s.gcr.io国内无法访问,这里指定阿里云镜像仓库地址 --kubernetes-version K8s版本,与上面安装的一致 --service-cidr 集群内部虚拟网络,Pod统一访问入口 --pod-network-cidr Pod网络,与下面部署的CNI网络组件yaml中保持一致 --ignore-preflight-errors=all 忽略错误 初始化完成后,最后会输出一个join命令,先记住,下面用。执行后返回Then you can join any number of worker nodes by running the following on each as root: kubeadm join 192.168.4.10:6443 --token oweerb.nonsh3zl5a8no0od \ --discovery-token-ca-cert-hash sha256:279352b82d65dd6bd470ea1b8c54542215696402a0d6bd8a20e53102f39f8a21 拷贝kubectl使用的连接k8s认证文件到默认路径 mkdir -p $HOME/.kube sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config sudo chown $(id -u):$(id -g) $HOME/.kube/config查看工作节点kubectl get nodes NAME STATUS ROLES AGE VERSION testk8s-master NotReady control-plane,master 104s v1.20.08、加入K8S node在Node节点执行192.168.4.11192.168.4.12向集群添加新节点,执行在kubeadm init输出的kubeadm join命令kubeadm join 192.168.4.10:6443 --token oweerb.nonsh3zl5a8no0od \ --discovery-token-ca-cert-hash sha256:279352b82d65dd6bd470ea1b8c54542215696402a0d6bd8a20e53102f39f8a21默认token有效期为24小时,当过期之后,该token就不可用了。这时就需要重新创建token,可以直接使用命令快捷生成kubeadm token create --print-join-command查看工作节点kubectl get nodes NAME STATUS ROLES AGE VERSION testk8s-master NotReady control-plane,master 3m42s v1.20.0 testk8s-node1 NotReady <none> 19s v1.20.0 testk8s-node2 NotReady <none> 16s v1.20.09、部署容器网络(CNI)Calico是一个纯三层的数据中心网络方案,是目前Kubernetes主流的网络方案。下载YAMLcurl https://docs.projectcalico.org/v3.20/manifests/calico.yaml -O下载完后还需要修改里面定义Pod网络(CALICO_IPV4POOL_CIDR),与前面kubeadm init的 --pod-network-cidr指定的一样。# The default IPv4 pool to create on startup if none exists. Pod IPs will be # chosen from this range. Changing this value after installation will have # no effect. This should fall within `--cluster-cidr`. - name: CALICO_IPV4POOL_CIDR value: "10.244.0.0/16"修改完后文件后,部署:kubectl apply -f calico.yaml kubectl get pods -n kube-system等Calico Pod都Running,节点也会准备就绪。注:以后所有yaml文件都只在Master节点执行!安装目录:/etc/kubernetes/组件配置文件目录:/etc/kubernetes/manifests/节点运行情况 kubectl get pods -n kube-system NAME READY STATUS RESTARTS AGE calico-kube-controllers-577f77cb5c-jrcfs 0/1 Pending 0 5s calico-node-fznrr 0/1 Init:0/3 0 6s calico-node-nrrwj 0/1 Init:0/3 0 6s calico-node-x7hds 0/1 Init:0/3 0 6s coredns-7f89b7bc75-6lr2s 0/1 Pending 0 7m18s coredns-7f89b7bc75-kwq9c 0/1 Pending 0 7m18s etcd-testk8s-master 1/1 Running 0 7m26s kube-apiserver-testk8s-master 1/1 Running 0 7m26s kube-controller-manager-testk8s-master 1/1 Running 0 7m26s kube-proxy-6pbwh 1/1 Running 0 4m9s kube-proxy-btgsz 1/1 Running 0 4m12s kube-proxy-cdfxc 1/1 Running 0 7m18s kube-scheduler-testk8s-master 1/1 Running 0 7m26s 会出现的一种情况是镜像下载失败calico-node-fznrr 0/1 Init:ImagePullBackOff 0 5m32s calico-node-nrrwj 0/1 Init:ImagePullBackOff 0 5m32s calico-node-x7hds 0/1 Init:ImagePullBackOff 0 5m32s 查看失败原因 kubectl describe po calico-node-fznrr -n kube-system Warning Failed 2m11s kubelet Failed to pull image "docker.io/calico/pod2daemon-flexvol:v3.20.6": rpc error: code = Unknown desc = Error response from daemon: Get "https://registry-1.docker.io/v2/": net/http: request canceled while waiting for connection (Client.Timeout exceeded while awaiting headers) Warning Failed 2m11s kubelet Error: ErrImagePull Normal BackOff 2m11s kubelet Back-off pulling image "docker.io/calico/pod2daemon-flexvol:v3.20.6" Warning Failed 2m11s kubelet Error: ImagePullBackOff Normal Pulling 116s (x2 over 5m31s) kubelet Pulling image "docker.io/calico/pod2daemon-flexvol:v3.20.6" 通过镜像站点下载 https://docker.aityp.com/image/docker.io/calico/pod2daemon-flexvol:v3.20.6docker pull swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/calico/pod2daemon-flexvol:v3.20.6 docker tag swr.cn-north-4.myhuaweicloud.com/ddn-k8s/docker.io/calico/pod2daemon-flexvol:v3.20.6 docker.io/calico/pod2daemon-flexvol:v3.20.6 等待自动修复完成calico-kube-controllers-577f77cb5c-jrcfs 0/1 ContainerCreating 0 22m calico-node-fznrr 0/1 Running 0 22m calico-node-nrrwj 1/1 Running 0 22m calico-node-x7hds 1/1 Running 0 22m 有时发生错误,重启k8s也能解决systemctl restart kubelet创建pod测试kubectl create deployment nginx --image=nginx查看pod状态kubectl get pod查看pod状态带节点和IPkubectl get pod -o wide NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES nginx-6799fc88d8-rqb82 1/1 Running 0 14m 10.244.236.3 testk8s-node1 <none> <none> 测试nginxcurl 10.244.236.3 <!DOCTYPE html> <html> <head> <title>Welcome to nginx!</title> 创建外部访问kubectl expose deployment nginx --port=80 --target-port=80 --type=NodePort查看外部端口 范围 30000以上kubectl get pod,svc NAME READY STATUS RESTARTS AGE pod/nginx-6799fc88d8-rqb82 1/1 Running 0 15m NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE service/kubernetes ClusterIP 10.96.0.1 <none> 443/TCP 46m service/nginx NodePort 10.101.228.228 <none> 80:32507/TCP 15s访问地址为http://192.168.4.11:32507/ http://192.168.4.12:32507/即Pod任意节点IP,组合service映射的端口10、部署dashboardYAML下载地址curl https://raw.githubusercontent.com/kubernetes/dashboard/v2.0.3/aio/deploy/recommended.yaml -O修改yaml,增加nodePort: 30001 type: NodePortkind: Service apiVersion: v1 metadata: labels: k8s-app: kubernetes-dashboard name: kubernetes-dashboard namespace: kubernetes-dashboard spec: type: NodePort ports: - port: 443 targetPort: 8443 nodePort: 30001 selector: k8s-app: kubernetes-dashboard部署dashboardkubectl apply -f recommended.yaml查看状态kubectl get pods -n kubernetes-dashboard创建service account并绑定默认cluster-admin管理员集群角色:创建用户kubectl create serviceaccount dashboard-admin -n kube-system用户授权kubectl create clusterrolebinding dashboard-admin --clusterrole=cluster-admin --serviceaccount=kube-system:dashboard-admin获取用户Tokenkubectl describe secrets -n kube-system $(kubectl -n kube-system get secret | awk '/dashboard-admin/ {print $1}') Name: dashboard-admin-token-sqtsm Namespace: kube-system Labels: <none> Annotations: kubernetes.io/service-account.name: dashboard-admin kubernetes.io/service-account.uid: 77ad4c5d-e4e0-4dc9-b014-7f679acf5aff Type: kubernetes.io/service-account-token Data ==== ca.crt: 1066 bytes namespace: 11 bytes token: eyJhbGciOiJSUzI1NiIsImtpZCI6InY0U0pqNDh2M0ZGMVdMTGdxSnNBcmxMaVFGVE9nMC1tMnhxQzFfZjF3aEUifQ.eyJpc3MiOiJrdWJlcm5ldGVzL3NlcnZpY2VhY2NvdW50Iiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9uYW1lc3BhY2UiOiJrdWJlLXN5c3RlbSIsImt1YmVybmV0ZXMuaW8vc2VydmljZWFjY291bnQvc2VjcmV0Lm5hbWUiOiJkYXNoYm9hcmQtYWRtaW4tdG9rZW4tc3F0c20iLCJrdWJlcm5ldGVzLmlvL3NlcnZpY2VhY2NvdW50L3NlcnZpY2UtYWNjb3VudC5uYW1lIjoiZGFzaGJvYXJkLWFkbWluIiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9zZXJ2aWNlLWFjY291bnQudWlkIjoiNzdhZDRjNWQtZTRlMC00ZGM5LWIwMTQtN2Y2NzlhY2Y1YWZmIiwic3ViIjoic3lzdGVtOnNlcnZpY2VhY2NvdW50Omt1YmUtc3lzdGVtOmRhc2hib2FyZC1hZG1pbiJ9.fwivtHsitw0ABTfb96HqIJ6N9SL23eiZtIjniqB1qRYIODkGJkOXKGpUmEXPRwR-pQr4glk1KDP9dB2xidET9IhZ-3iKt_5K8xb9K3aELG9yOzzH0Xmi88SaY6A6ZrABaCjjTcp80d-5FgQhRB6ruMLnD1N7vftYk1Sf37HvZ_bKApq1C6uebKnMd0M2EcPckjepvSXmD6fdsosTAJrTYeEpcFCjR6IS5R9bnrN7ADwFZHu-kEekhhV7g888REdhnbSkAvzE9OYbIf7uVgTkh6C_ZhJEzODViHS_RDkiEbZSqs0Q53h50CgL8tj3CBrkV9FvO7SoKVCtvTkYZyPfcQ 访问地址:https://NodeIP:30001任何节点都可以访问https://192.168.4.10:30001/ https://192.168.4.11:30001/EDGE访问出现你的连接不是专用链接,没有继续访问按钮时解决办法保持焦点在页面内,鼠标在页面空白处点击(不选中任何按钮),直接输入“thisisunsafe”,输完后按回车键,就可以正常访问网页。这里要注意的是,输入的时候页面时不会有任何反应的,也不会显示输入的字符,是正常现象。输入完毕后点回车即可。输入Token登录token: eyJhbGciOiJSUzI1NiIsImtpZCI6InY0U0pqNDh2M0ZGMVdMTGdxSnNBcmxMaVFGVE9nMC1tMnhxQzFfZjF3aEUifQ.eyJpc3MiOiJrdWJlcm5ldGVzL3NlcnZpY2VhY2NvdW50Iiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9uYW1lc3BhY2UiOiJrdWJlLXN5c3RlbSIsImt1YmVybmV0ZXMuaW8vc2VydmljZWFjY291bnQvc2VjcmV0Lm5hbWUiOiJkYXNoYm9hcmQtYWRtaW4tdG9rZW4tc3F0c20iLCJrdWJlcm5ldGVzLmlvL3NlcnZpY2VhY2NvdW50L3NlcnZpY2UtYWNjb3VudC5uYW1lIjoiZGFzaGJvYXJkLWFkbWluIiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9zZXJ2aWNlLWFjY291bnQudWlkIjoiNzdhZDRjNWQtZTRlMC00ZGM5LWIwMTQtN2Y2NzlhY2Y1YWZmIiwic3ViIjoic3lzdGVtOnNlcnZpY2VhY2NvdW50Omt1YmUtc3lzdGVtOmRhc2hib2FyZC1hZG1pbiJ9.fwivtHsitw0ABTfb96HqIJ6N9SL23eiZtIjniqB1qRYIODkGJkOXKGpUmEXPRwR-pQr4glk1KDP9dB2xidET9IhZ-3iKt_5K8xb9K3aELG9yOzzH0Xmi88SaY6A6ZrABaCjjTcp80d-5FgQhRB6ruMLnD1N7vftYk1Sf37HvZ_bKApq1C6uebKnMd0M2EcPckjepvSXmD6fdsosTAJrTYeEpcFCjR6IS5R9bnrN7ADwFZHu-kEekhhV7g888REdhnbSkAvzE9OYbIf7uVgTkh6C_ZhJEzODViHS_RDkiEbZSqs0Q53h50CgL8tj3CBrkV9FvO7SoKVCtvTkYZyPfcQ11、查看日志查看容器日志kubectl logs 容器名称 -n kube-system kubectl get pod NAME READY STATUS RESTARTS AGE nginx-6799fc88d8-rqb82 1/1 Running 0 37m kubectl logs nginx-6799fc88d8-rqb82 /docker-entrypoint.sh: /docker-entrypoint.d/ is not empty, will attempt to perform configuration /docker-entrypoint.sh: Looking for shell scripts in /docker-entrypoint.d/ /docker-entrypoint.sh: Launching /docker-entrypoint.d/10-listen-on-ipv6-by-default.sh查看容器事件kubectl describe pod 容器名称 -n kube-system kubectl describe pod nginx-6799fc88d8-rqb82 Name: nginx-6799fc88d8-rqb82 Namespace: default Priority: 0 Node: testk8s-node1/192.168.4.11 Start Time: Wed, 22 Oct 2025 14:17:29 +0800 Labels: app=nginx pod-template-hash=6799fc88d8查看calico.yaml所需要的镜像 grep image calico.yaml image: docker.io/calico/cni:v3.20.6 image: docker.io/calico/cni:v3.20.6 image: docker.io/calico/pod2daemon-flexvol:v3.20.6 image: docker.io/calico/node:v3.20.6 image: docker.io/calico/kube-controllers:v3.20.6 cailco镜像下载失败时解决办法通过镜像站下载 https://docker.aityp.com/清空部署环境kubeadm reset系统命令补全 yum install bash-completion -y{lamp/}扩展学习docker切换containerd1、先决条件节点执行 cat <<EOF | tee /etc/modules-load.d/containerd.conf overlay br_netfilter EOF modprobe overlay modprobe br_netfilter 设置内核参数 cat <<EOF | tee /etc/sysctl.d/99-kubernetes-cri.conf net.bridge.bridge-nf-call-iptables = 1 net.ipv4.ip_forward = 1 net.bridge.bridge-nf-call-ip6tables = 1 EOF 生效内核参数 sysctl --system2、安装containerd 节点执行安装依赖包yum install -y yum-utils device-mapper-persistent-data lvm2安装docker仓库更新系统、安装containerdyum update -y yum install -y containerd.io配置containerd创建配置目录 mkdir -p /etc/containerd 创建默认配置文件 containerd config default | sudo tee /etc/containerd/config.toml重启containerdsystemctl restart containerd修改配置文件vi /etc/containerd/config.toml sandbox_image = "registry.k8s.io/pause:3.6" 修改为 registry.aliyuncs.com/google_containers/pause:3.2 SystemdCgroup = false 修改为 SystemdCgroup = true [plugins."io.containerd.grpc.v1.cri".registry.mirrors] 下增加两行 [plugins."io.containerd.grpc.v1.cri".registry.mirrors."docker.io"] endpoint = ["https://docker.xuanyuan.me/"] 对接kubeletvi /etc/sysconfig/kubelet KUBELET_EXTRA_ARGS=--container-runtime=remote --container-runtime-endpoint=unix:///run/containerd/containerd.sock --cgroup-driver=systemd停止dockersystemctl stop docker.socket&&systemctl stop docker && systemctl disable docker3、替换容器引擎master查看K8S状态kubectl get node NAME STATUS ROLES AGE VERSION k8s-master Ready control-plane,master 25h v1.20.0 k8s-node1 NotReady <none> 25h v1.20.0 k8s-node2 Ready <none> 25h v1.20.0节点重启kubeletsystemctl restart kubelet稍后master再次查看K8S状态kubectl get node NAME STATUS ROLES AGE VERSION k8s-master Ready control-plane,master 25h v1.20.0 k8s-node1 Ready <none> 25h v1.20.0 k8s-node2 Ready <none> 25h v1.20.0mater查看详细节点信息kubectl get node -o wide NAME STATUS ROLES AGE VERSION INTERNAL-IP EXTERNAL-IP OS-IMAGE KERNEL-VERSION CONTAINER-RUNTIME k8s-master Ready control-plane,master 25h v1.20.0 192.168.4.10 <none> CentOS Linux 7 (Core) 3.10.0-1160.el7.x86_64 docker://26.1.4 k8s-node1 Ready <none> 25h v1.20.0 192.168.4.11 <none> CentOS Linux 7 (Core) 3.10.0-1160.el7.x86_64 containerd://1.6.33 k8s-node2 Ready <none> 25h v1.20.0 192.168.4.12 <none> CentOS Linux 7 (Core) 3.10.0-1160.el7.x86_64 docker://26.1.4更多K8S命令查看master组件状态kubectl get cs查看k8s所有资源kubectl api-resources查看node状态kubectl get node 查看APIserver代理的URLkubectl cluster-info查看集群详细信息kubectl cluster-info dump查看资源信息kubectl describe pod 名称 查看事件 kubectl get pods --watch 实时查看pod -

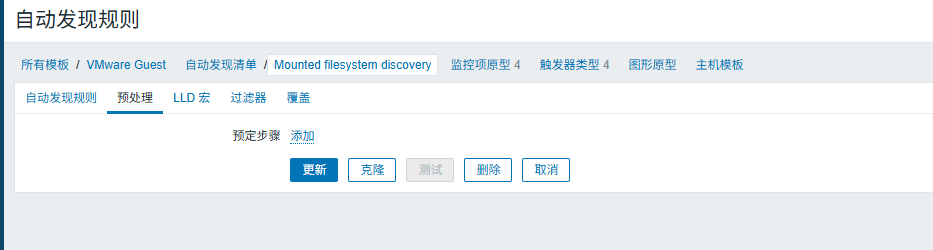

zabbix7.0 7.2 VMware Guest模板 "Unknown file system path" 模板BUG 在zabbix7.0 7.2的默认VMware Guest模板中,自动发现Mounted filesystem discovery,官方增加了一个预处理JavaScript,此脚本会导致windows系统获取的C盘是 c: 而不是 c:\ ,从而获取不到磁盘空间,提示 Unknown file system path更妙的是,这个JavaScript删掉模板就能正常工作了,因为在zabbix6.0里就没有这个预处理,也不影响linux主机,只是针对windows的预处理const data = JSON.parse(value); for (var i in data) { if (data[i]['{#FSNAME}'].endsWith('\\')) { data[i]['{#FSNAME}'] = data[i]['{#FSNAME}'].replace(/\\+$/, ''); } } return JSON.stringify(data);删除预处理即可删除后可以获取磁盘空间

zabbix7.0 7.2 VMware Guest模板 "Unknown file system path" 模板BUG 在zabbix7.0 7.2的默认VMware Guest模板中,自动发现Mounted filesystem discovery,官方增加了一个预处理JavaScript,此脚本会导致windows系统获取的C盘是 c: 而不是 c:\ ,从而获取不到磁盘空间,提示 Unknown file system path更妙的是,这个JavaScript删掉模板就能正常工作了,因为在zabbix6.0里就没有这个预处理,也不影响linux主机,只是针对windows的预处理const data = JSON.parse(value); for (var i in data) { if (data[i]['{#FSNAME}'].endsWith('\\')) { data[i]['{#FSNAME}'] = data[i]['{#FSNAME}'].replace(/\\+$/, ''); } } return JSON.stringify(data);删除预处理即可删除后可以获取磁盘空间 -

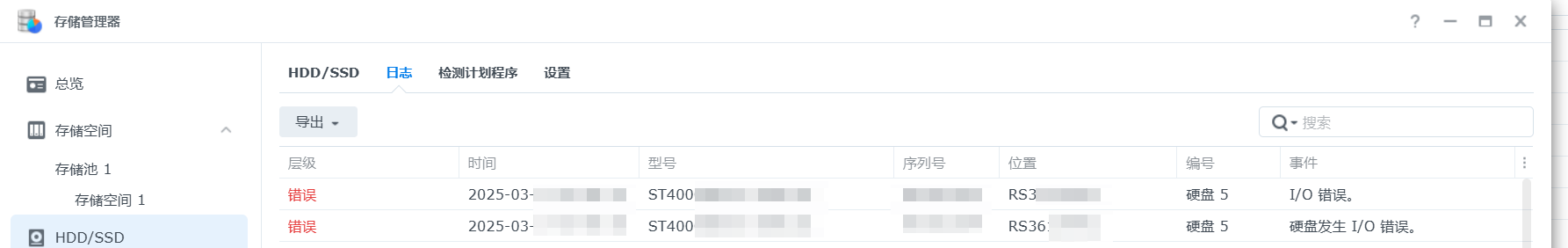

OceanBase OB原生分布式数据库V4社区版高可用部署、OCP云平台、OMS迁移服务部署zabbix6数据迁移、1Panel面板adminer web数据库管理工具、minio S3备份还原计划、集群扩容缩容、租户扩容缩容、ODC开发者中心、OBProxy集群keepalived高可用主备VIP部署、故障处理、不停机滚动升级 {alert type="info"}本文使用vSAN集群进行真实安装,密码均为随机生成,试验结束后销毁网段和集群;虽为模拟实验,但完全适用于真实生产环境;因为使用的虚拟机,所以硬盘分区无意义,仅一个根分区500G。{/alert}本文已加入 《OceanBase 4.x DBA 进阶教程》用户共建计划https://ask.oceanbase.com/t/topic/35617370/所有参与共建的用户,都会出现在 OceanBase 进阶教程电子书的致谢名单中,欢迎大家加入~一、OceanBase 社区版为现代数据架构打造的开源分布式数据库。兼容 MySQL 的单机分布式一体化国产开源数据库,具有原生分布式架构,支持金融级高可用、透明水平扩展、分布式事务、多租户和语法兼容等企业级特性。OceanBase 内核通过大规模商用场景的考验,已服务众多行业客户;面向未来携手生态伙伴,共建开源开放的数据库内核和生态。文档:https://www.oceanbase.com/docs{lamp/}二、OCP云平台部署OceanBase 云平台(OceanBase Cloud Platform,OCP)是一款为 OceanBase 集群量身打造的企业级管理平台,兼容 OceanBase 所有主流版本。OCP 提供对 OceanBase 图形化管理能力,包括数据库及相关资源的全生命周期管理、监控告警、性能诊断、故障恢复、备份恢复等,旨在协助客户更加高效地管理 OceanBase 数据库,降低企业的IT运维成本和用户的学习成本。https://www.oceanbase.com/docs/ocp1、主机规划本教程部署简化版集群 1ocp 1oms 2proxy 3zone6server 共10台主机,另外独立安装zabbix6和minioocp配置 16C 64G 500G其他主机配置 8C 32G 500G操作系统为anolis8,全部关闭防火墙tntocp 192.168.4.100 tntoms 192.168.4.101 tntproxy1 192.168.4.102 tntproxy2 192.168.4.103 tntob1-1 192.168.4.104 tntob1-2 192.168.4.105 tntob2-1 192.168.4.106 tntob2-2 192.168.4.107 tntob3-1 192.168.4.108 tntob3-2 192.168.4.109 tntzabbix6 192.168.4.110 tntminio 192.168.4.111 tntproxy 192.168.4.99 keepalived虚拟IP2、安装准备下载OceanBase社区版一键安装包 (OceanBase All in One)OceanBase 数据库一键离线安装包,包括 OceanBase 数据库和 OCP(自 V4.3.3 起包含)、obd、OBProxy、OBClient、OCP Express、Prometheus、Grafana,以及诊断和测试工具。https://www.oceanbase.com/softwarecenterOCP依赖仅支持 JDK1.8 版本,下载并安装 jre-8u441-linux-x64.rpmhttps://www.java.com/en/download/manual.jsp3、图形化部署OCP所有主机关闭防火墙systemctl stop firewalld && systemctl disable firewalld上传一键安装包至OCP主机、解压安装解压 tar zxf oceanbase-all-in-one-4.3.5_bp1_20250320.el8.x86_64.tar.gz启动obdcd oceanbase-all-in-one/bin source ~/.oceanbase-all-in-one/bin/env.sh obd web install生成网页安装URL进入 OCP 部署向导页面部署OCP云平台并创建全新数据库设置集群名称创建metaDB,我这里使用ocp主机单机部署metaDB,即OCP、数据库节点、OBProxy都是一台服务器OCP 资源规划为20台主机预检查无异常部署中,等待部署完成,记好账号密码{lamp/}三、OCP云平台使用1、登录OCP云平台http://192.168.4.100:8080看到OCP平台初始化失败查看异常为netstat: 未找到命令{message type="info" content="注意,所有OB主机都需要netstat,通过yum安装"/}yum install net-tools -y所有OB主机都需要netstat!全部安装一遍点击重启,执行成功OCP部署成功2、OCP操作流程添加主机-新建集群-创建租户-创建用户-创建OBProxy集群3、添加作为OBProxy集群和OBserver的主机192.168.4.102-109主机标准化分为OBProxy和OceanBase,等待标准化完成OBProxy标准化无异常但也需要修复一下,OceanBase标准化有8个异常,都需要修复修复检查透明大页 echo never > /sys/kernel/mm/transparent_hugepage/enabled 生效 chmod +x /etc/rc.d/rc.local 添加到开机启动 vi /etc/rc.d/rc.local echo never > /sys/kernel/mm/transparent_hugepage/enabled 安装python2.7 yum install python2 -y 禁用swap分区 swapoff -a 删除swap分区 /etc/fstab 安装软件 yum -y install net-tools mtr tar binutils bind-utils curl nc iproute 添加admin用户 groupadd -g 500 admin useradd -m -u 500 -g 500 -s /bin/bash admin id admin 关闭selinux 检查ulimit信息 /etc/security/limits.d/99-oceanbase_limits.conf root soft nofile 655350 root hard nofile 655350 admin soft nofile 655350 admin hard nofile 655350 admin soft stack 10240 admin hard stack 10240 admin soft nproc 655360 admin hard nproc 655360 admin soft core unlimited admin hard core unlimited 检查 clocksource 信息 echo tsc > /sys/devices/system/clocksource/clocksource0/current_clocksource 时间同步 调整端口范围,保留端口 sudo sysctl net.ipv4.ip_local_port_range vi /etc/sysctl.conf net.ipv4.ip_local_port_range = 3500 65535 net.ipv4.ip_local_reserved_ports = 62881-63881 生效 sudo sysctl -p python2软连接到python sudo ln -sf /usr/bin/python2 /usr/bin/python 创建软件目录 mkdir /data/log1 -p mkdir /data/1 -p 重新检查,修复完成4、新建集群新建tntob集群,3zone,每zone 2台主机,由于是实验集群,我没有开启cgroup创建中安装完成5、创建租户创建zabbix6租户Unit规格选择S1并允许所有IP访问创建完成6、创建用户在zabbix6租户中创建用户zabbixdb,先不用创建数据库,一会直接导入一个数据库7、创建OBProxy集群创建tntproxy集群,加入102、103两台主机{message type="info" content="注意:102、103都可以访问集群,而访问地址,一般指的是负载均衡设备的VIP地址,暂不讨论,这里访问地址先填写102"/}创建完成连接到tntob集群8、连接测试使用adminer登陆测试一下连接参数 mysql -h192.168.4.102 -P2883 -uroot@zabbix6#tntob -p登录成功OceanBase分布式数据库集群部署完毕{lamp/}四、OMS迁移服务部署zabbix6数据迁移OMS文档https://www.oceanbase.com/docs/oms-cn1、创建oms租户创建oms租户作为OMS迁移服务的元数据库,需要使用租户的root用户2、安装OMS迁移服务下载软件包 oms_4.2.8-ce.tar.gz 上传到tntoms主机https://www.oceanbase.com/softwarecenter安装dockeryum install -y yum-utils #阿里云加速源 yum-config-manager --add-repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo yum install docker-ce docker-ce-cli containerd.io启动dockersystemctl enable --now docker导入镜像docker load -i oms_4.2.8-ce.tar.gz查看镜像名docker images REPOSITORY TAG IMAGE ID CREATED SIZE reg.docker.alibaba-inc.com/oceanbase/oms feature_4.2.8_ce d56598287295 7 weeks ago 10.9GB 获取部署脚本sudo docker run -d --net host --name oms-config-tool reg.docker.alibaba-inc.com/oceanbase/oms:feature_4.2.8_ce bash && sudo docker cp oms-config-tool:/root/docker_remote_deploy.sh . && sudo docker rm -f oms-config-tool 启动部署mkdir /oms bash docker_remote_deploy.sh -o /oms -i 192.168.4.101 -d reg.docker.alibaba-inc.com/oceanbase/oms:feature_4.2.8_ce 安装中 ****CPU**** CPU_Name(System_Name): Intel(R) Xeon(R) Silver 4309Y CPU @ 2.80GHz Total_physical_CPU: 8 Total_core_num: 8 *****Memory****** Total_Mem: 32915048 KB Total_Mem: 31 G *****Disk****** Total_disk_avail: 954 G 提示:输入 <Control-C> 可退出部署 请选择部署模式: ●单地域单节点 单地域多节点 多地域 您选择的部署模式是:单地域单节点部署模式 请选择您所需要进行的任务: ●无配置文件,全新部署 OMS,从生成配置文件开始 已通过脚本[-c]选项传入参考配置文件,基于参考配置文件开始配置 开始配置元信息库,可以是 MySQL 或 OceanBase 数据库 MySQL 租户 (元信息库用于存储 OMS 运行时元数据信息) 请输入元信息数据库 IP:192.168.4.102 请输入元信息数据库端口:2883 请输入元信息数据库用户名:root@oms#tntob 请输入元信息数据库密码:*********************** 请为 OMS 元数据库设置前缀 (示例:当前缀设置为 oms 时,最终库名分别为 oms_rm/oms_cm/oms_cm_hb): 您的元信息库配置如下: { "drc_cm_db": "_cm", "drc_cm_heartbeat_db": "_cm_hb", "drc_rm_db": "_rm", "init_db": "true", "oms_meta_host": "192.168.4.102", "oms_meta_password": "9cb;CcrN1C3f,Xlub)rx{(#", "oms_meta_port": "2883", "oms_meta_user": "root@oms#tntob" } [y/n] 请确认配置信息[y]y 您选择的部署模式为单地域单节点部署模式 [y/n] 是否自定义组件端口号,并配置相关参数?[n]n [y/n] 获取到您的默认 IP 地址:192.168.4.101,请确认是否需要更改?[n]n 您的 OMS 集群配置如下: { "cm_is_default": true, "cm_location": 0, "cm_nodes": [ "192.168.4.101" ], "cm_region": "default", "cm_region_cn": "默认地域", "cm_server_port": "8088", "cm_url": "http://192.168.4.101:8088", "ghana_server_port": "8090", "nginx_server_port": "8089", "sshd_server_port": "2023", "supervisor_server_port": "9000" } [y/n] 请确认配置信息[y]y [y/n] 您是否需要对 OMS 历史数据进行监控?[n]n [y/n] 是否需要开启 OMS 审计日志功能,并将审计日志写入 SLS 服务?[n]n 已加载您的所有配置项,并校验通过。 您的配置如下: { "apsara_audit_enable": "false", "apsara_audit_sls_access_key": "", "apsara_audit_sls_access_secret": "", "apsara_audit_sls_endpoint": "", "apsara_audit_sls_ops_site_topic": "", "apsara_audit_sls_user_site_topic": "", "cm_is_default": true, "cm_location": "0", "cm_nodes": [ "192.168.4.101" ], "cm_region": "default", "cm_region_cn": "默认地域", "cm_server_port": "8088", "cm_url": "http://192.168.4.101:8088", "drc_cm_db": "_cm", "drc_cm_heartbeat_db": "_cm_hb", "drc_rm_db": "_rm", "ghana_server_port": "8090", "init_db": "true", "nginx_server_port": "8089", "oms_meta_host": "192.168.4.102", "oms_meta_password": "9cb;CcrN1C3f,Xlub)rx{(#", "oms_meta_port": "2883", "oms_meta_user": "root@oms#tntob", "sshd_server_port": "2023", "supervisor_server_port": "9000", "tsdb_enabled": "false", "tsdb_password": "", "tsdb_service": "", "tsdb_url": "", "tsdb_username": "" } [y/n] 您是否需要重新配置?[n]n 您是需要在当前执行的机器上 接下来 OMS 需要在节点 ['192.168.4.101'] 上依次执行部署脚本。 请输入节点 192.168.4.101 上预备部署 OMS 的挂载目录:[/oms/]/oms/ 请您确认以下内容: [y/n] 部署 OMS 的 [镜像名/IMAGE-ID] 是:reg.docker.alibaba-inc.com/oceanbase/oms:feature_4.2.8_ce ,请确认是否正确。[y]y [y/n] 是否需要在 OMS 容器中挂载 HTTPS 证书?[n]n [y/n] 192.168.4.101 节点下的配置文件 config.yaml 将写在这个路径:/oms/ 下可以吗?[y]y ....... -------------------------------------------------------------------------------- # 【结束】全部初始化步骤执行成功 -------------------------------------------------------------------------------- 登录控制台,首次登陆设置密码http://192.168.4.101:8089/3、zabbix6安装查看王工zabbix6文章快速部署,部署完成后迁移到OceanBase集群https://90apt.com/2982安装完成4、导出zabbix6数据库结构使用adminer导出数据库结构,不包括数据adminer安装见后面1Panel部分使用adminer导入到zabbix租户中5、OMS全量迁移在OCP中给zabbixuser用户赋予zabbix数据库全部权限添加双方数据源配置迁移任务启动任务迁移完成,进行切换6、zabbix6切换数据库,重启服务、查看日志配置文件修改/etc/zabbix/web/zabbix.conf.php<?php // Zabbix GUI configuration file. $DB['TYPE'] = 'MYSQL'; $DB['SERVER'] = '192.168.4.102'; $DB['PORT'] = '2883'; $DB['DATABASE'] = 'zabbix'; $DB['USER'] = 'zabbixuser@zabbix6#tntob'; $DB['PASSWORD'] = 'r*h(c^rLst8F'; /etc/zabbix/zabbix_server.confDBHost=192.168.4.102 DBName=zabbix DBUser=zabbixuser@zabbix6#tntob DBPassword=r*h(c^rLst8F DBPort=2883重启zabbix服务 systemctl restart zabbix-server查看日志是否有异常/var/log/zabbix/zabbix_server.logUnable to start Zabbix server due to unsupported MySQL database version (5.06.25).修改OBPorxy数据版本,修改为8.0.0再次重启zabbix服务查看日志,无异常zabbix功能正常,采集正常{lamp/}五、1Panel面板minio S3备份还原计划1、安装docker安装dockeryum install -y yum-utils #阿里云加速源 yum-config-manager --add-repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo yum install docker-ce docker-ce-cli containerd.io启动dockersystemctl enable --now docker2、安装1Panel面板curl -sSL https://resource.fit2cloud.com/1panel/package/quick_start.sh -o quick_start.sh && sh quick_start.sh安装adminer web数据库管理工具支持MySQL、MariaDB、 SQLite、PostgreSQL、Oracle (beta)、MS SQL3、安装minio,配置S3存储登录1Panel面板安装minio登录minio创建Bucket创建Access Keys4、配置备份计划创建zabbix6租户备份策略存储目录为Bucket名称访问域名为API的URL http://192.168.4.111:9000在填入AK、SK,点击测试即可立即备份备份完成5、进行还原测试误删数据库由于王工上年纪老眼昏花,不小心删除了zabbix数据库,不稳啦!zabbix崩溃进行租户恢复恢复完成创建了新的租户,将原租户改名,新租户改为原来的名,这样业务就不用动了业务恢复了,王工又稳啦!{lamp/}六、集群、租户扩缩容1、集群扩容添加主机-集群管理-添加OBServer、新增Zone添加主机OCP云平台-主机-添加主机主机还是要按之前标准化进行环境修复,修复好再添加再次进行标准化OCP云平台-集群-概览-添加OBServer一段时间后部署模式变为集群 (3-3-3)新增Zone与之相同2、集群缩容https://www.oceanbase.com/docs/common-oceanbase-database-cn-1000000002013120删除OBServer时自动进行Unit迁出完成缩容我这边删除114 115 116三台主机批量删除删除中缩容完成3、租户扩容进入租户修改UnitOCP云平台-租户-概览-修改Unit如,将配置修改为S2,Unit修改为2扩容成功4、租户缩容如,将配置修改为S1,Unit修改为1缩容完成{lamp/}七、ODC开发者中心OceanBase 开发者中心(OceanBase Developer Center,ODC)是开源的企业级数据库协同开发工具,有桌面版、Web 版两种产品形态。 ODC Web 版提供了个人空间和团队空间两种工作模式。个人空间适合个人开发者使用,为您在浏览器端提供桌面版的体验;团队空间适合开发者和 DBA 协同使用,既是开发工具也是管控协同平台。 ODC 的代码维护在 Github,单击查看详情,加入 ODC 开源社区,一起创造 开发者和 DBA 喜爱的数据库协同开发工具。https://www.oceanbase.com/docs/odc{message type="info" content="注意:按官方教程你很可能装不上,还是看我的吧"/}1、下载OceanBase 开发者中心web镜像上传到OMS主机,我将ODC安装在OMS主机,ODC为docker镜像https://www.oceanbase.com/softwarecenter2、为ODC创建一个mysql租户并创建一个数据库创建tntodc租户 tntodc数据库 root用户{message type="info" content="注意:数据库用户我测试用普通用户无法部署ODC,需要root用户"/}3、加载镜像gunzip -c obodc4.3.3-bp2.tar.gz | docker load查看镜像docker images REPOSITORY TAG IMAGE ID CREATED SIZE reg.docker.alibaba-inc.com/oceanbase/oms feature_4.2.8_ce d56598287295 7 weeks ago 10.9GB oceanbase/odc 4.3.3_bp2 98a74ab3fbe1 7 weeks ago 1.75GB 4、创建安装脚本odcinstall.sh#!/usr/bin/env bash mkdir -p /tntodc/log/odc mkdir -p /tntodc/data/odc docker run -v /tntodc/log/odc:/opt/odc/log -v /tntodc/data/odc:/opt/odc/data \ -d -i -p 8989:8989 --cpu-period 100000 --cpu-quota 400000 --memory 8G --name "obodc" \ -e "DATABASE_HOST=192.168.4.102" \ -e "DATABASE_PORT=2883" \ -e "DATABASE_USERNAME=root@tntodc#tntob" \ -e "DATABASE_PASSWORD=78ABcd##123" \ -e "DATABASE_NAME=tntodc" \ -e "ODC_ADMIN_INITIAL_PASSWORD=78ABcd##123" \ oceanbase/odc:4.3.3_bp2 注意Shell 环境下,字符串中包含 !、$ 等特殊字符时,变量值需要使用单引号。例如:DATABASE_PASSWORD='11111!'。参数 ODC_ADMIN_INITIAL_PASSWORD 用于指定 ODC 管理员账号的初始密码。设置的初始密码需要须满足以下条件:至少 2 个数字。至少 2 个大写字母。至少 2 个小写字母。至少 2 个特殊字符,特殊字符的范围为 ._+@#$%。不包含空格和其他特殊字符,长度为 8-32。{lamp/}5、安装bash odcinstall.sh6、登录成功八、OBProxy集群keepalived高可用主备VIP部署keepalived介绍请看王工其他文章1、安装keepalived两台OBProxy主机分别安装keepalivedyum install -y keepalived2、配置keepalived两台OBProxy主机分别创建Proxy存活检测脚本vi /etc/keepalived/check_obproxy.sh#!/bin/bash # 检查2883端口是否有监听 if ss -tuln | grep -q ':2883\b'; then exit 0 # 检测成功,返回0 else exit 1 # 检测失败,返回1 fitntproxy1配置执行权限chmod +x /etc/keepalived/check_obproxy.sh配置文件vi /etc/keepalived/keepalived.conf! Configuration File for keepalived global_defs { router_id keepalived1 #只是名字而已,辅节点改为keepalived2(两个名字一定不能一样) } vrrp_script check_obproxy { script "/etc/keepalived/check_obproxy.sh" interval 2 #每2秒执行一次 } vrrp_instance VI_1 { state MASTER #定义主还是备,备用的话写backup interface ens192 #VIP绑定接口 virtual_router_id 66 #整个集群的调度器一致(在同一个集群) priority 100 #(优先权)back改为50(50一间隔) advert_int 1 #发包 authentication { auth_type PASS #主备节点认证 auth_pass 1111 } unicast_src_ip 192.168.4.102 #本机ip unicast_peer { 192.168.4.103 #其他机器ip,可多个 } virtual_ipaddress { 192.168.4.99/24 #VIP(自己网段的) } track_script { check_obproxy } }tntproxy2配置执行权限chmod +x /etc/keepalived/check_obproxy.sh配置文件vi /etc/keepalived/keepalived.conf! Configuration File for keepalived global_defs { router_id keepalived2 } vrrp_script check_obproxy { script "/etc/keepalived/check_obproxy.sh" interval 2 #每2秒执行一次 } vrrp_instance VI_1 { state BACKUP #设置为backup interface ens192 nopreempt #设置到back上面,不抢占资源 virtual_router_id 66 priority 50 #辅助改为50 advert_int 1 #检测间隔1s authentication { auth_type PASS auth_pass 1111 #认证类型和密码主备一样,要不然无法互相认证 } unicast_src_ip 192.168.4.103 #本机ip unicast_peer { 192.168.4.102 #其他机器ip,可多个 } virtual_ipaddress { 192.168.4.99/24 #抢占的VIP也一样 } track_script { check_obproxy } }3、启动服务systemctl enable --now keepalived4、高可用测试将zabbix数据库指向VIP,连续ping 192.168.4.99,并查看zabbix服务状态obproxy1关机,查看ping和zabbix状态正常,业务几乎无感来自 192.168.4.99 的回复: 字节=32 时间=15ms TTL=63 来自 192.168.4.99 的回复: 字节=32 时间=21ms TTL=63 来自 192.168.4.99 的回复: 字节=32 时间=28ms TTL=63 来自 192.168.4.99 的回复: 字节=32 时间=2ms TTL=63 来自 192.168.4.99 的回复: 字节=32 时间=49ms TTL=63 来自 192.168.4.99 的回复: 字节=32 时间=1ms TTL=63obproxy2获得VIPinet 192.168.4.103/24 brd 192.168.4.255 scope global noprefixroute ens192 valid_lft forever preferred_lft forever inet 192.168.4.99/24 scope global secondary ens192 valid_lft forever preferred_lft forever obproxy1开机,obproxy服务启动成功后,自动抢回VIP inet 192.168.4.102/24 brd 192.168.4.255 scope global noprefixroute ens192 valid_lft forever preferred_lft forever inet 192.168.4.99/24 scope global secondary ens192 valid_lft forever preferred_lft forever 5、测试结论高可用正常,VIP正常九、故障处理1、任意一台OBServer主机故障关机1台OBServer主机,集群无影响,一段时间后Zone内另一台主机接管此OBServer功能开机此OBServer,一段时间后集群自动修复此主机并上线2、{lamp/}十、不停机滚动升级V4.3.5_CE_BP1_HF1版本信息发布时间:2025 年 04 月 30 日下载数据库rpm安装包oceanbase-ce-4.3.5.1-101010042025042417.el8.x86_64.rpmhttps://www.oceanbase.com/softwarecenter登录OCP平台,进入集群,升级版本上传安装包升级路经确认提示 集群升级缺少社区版依赖包:[oceanbase-ce-utils-4.3.5.1-101010042025042417.x86_64, oceanbase-ce-libs-4.3.5.1-101010042025042417.x86_64]下载并上传oceanbase-ce-libs-4.3.5.1-101010042025042417.el8.x86_64.rpmoceanbase-ce-utils-4.3.5.1-101010042025042417.el8.x86_64.rpm升级中升级前版本升级中如果出现任务失败,根据情况可点击重试,我点了四五次就完成了升级后版本,升级完成,升级过程中业务无感知{lamp/}十一、总结太强了

OceanBase OB原生分布式数据库V4社区版高可用部署、OCP云平台、OMS迁移服务部署zabbix6数据迁移、1Panel面板adminer web数据库管理工具、minio S3备份还原计划、集群扩容缩容、租户扩容缩容、ODC开发者中心、OBProxy集群keepalived高可用主备VIP部署、故障处理、不停机滚动升级 {alert type="info"}本文使用vSAN集群进行真实安装,密码均为随机生成,试验结束后销毁网段和集群;虽为模拟实验,但完全适用于真实生产环境;因为使用的虚拟机,所以硬盘分区无意义,仅一个根分区500G。{/alert}本文已加入 《OceanBase 4.x DBA 进阶教程》用户共建计划https://ask.oceanbase.com/t/topic/35617370/所有参与共建的用户,都会出现在 OceanBase 进阶教程电子书的致谢名单中,欢迎大家加入~一、OceanBase 社区版为现代数据架构打造的开源分布式数据库。兼容 MySQL 的单机分布式一体化国产开源数据库,具有原生分布式架构,支持金融级高可用、透明水平扩展、分布式事务、多租户和语法兼容等企业级特性。OceanBase 内核通过大规模商用场景的考验,已服务众多行业客户;面向未来携手生态伙伴,共建开源开放的数据库内核和生态。文档:https://www.oceanbase.com/docs{lamp/}二、OCP云平台部署OceanBase 云平台(OceanBase Cloud Platform,OCP)是一款为 OceanBase 集群量身打造的企业级管理平台,兼容 OceanBase 所有主流版本。OCP 提供对 OceanBase 图形化管理能力,包括数据库及相关资源的全生命周期管理、监控告警、性能诊断、故障恢复、备份恢复等,旨在协助客户更加高效地管理 OceanBase 数据库,降低企业的IT运维成本和用户的学习成本。https://www.oceanbase.com/docs/ocp1、主机规划本教程部署简化版集群 1ocp 1oms 2proxy 3zone6server 共10台主机,另外独立安装zabbix6和minioocp配置 16C 64G 500G其他主机配置 8C 32G 500G操作系统为anolis8,全部关闭防火墙tntocp 192.168.4.100 tntoms 192.168.4.101 tntproxy1 192.168.4.102 tntproxy2 192.168.4.103 tntob1-1 192.168.4.104 tntob1-2 192.168.4.105 tntob2-1 192.168.4.106 tntob2-2 192.168.4.107 tntob3-1 192.168.4.108 tntob3-2 192.168.4.109 tntzabbix6 192.168.4.110 tntminio 192.168.4.111 tntproxy 192.168.4.99 keepalived虚拟IP2、安装准备下载OceanBase社区版一键安装包 (OceanBase All in One)OceanBase 数据库一键离线安装包,包括 OceanBase 数据库和 OCP(自 V4.3.3 起包含)、obd、OBProxy、OBClient、OCP Express、Prometheus、Grafana,以及诊断和测试工具。https://www.oceanbase.com/softwarecenterOCP依赖仅支持 JDK1.8 版本,下载并安装 jre-8u441-linux-x64.rpmhttps://www.java.com/en/download/manual.jsp3、图形化部署OCP所有主机关闭防火墙systemctl stop firewalld && systemctl disable firewalld上传一键安装包至OCP主机、解压安装解压 tar zxf oceanbase-all-in-one-4.3.5_bp1_20250320.el8.x86_64.tar.gz启动obdcd oceanbase-all-in-one/bin source ~/.oceanbase-all-in-one/bin/env.sh obd web install生成网页安装URL进入 OCP 部署向导页面部署OCP云平台并创建全新数据库设置集群名称创建metaDB,我这里使用ocp主机单机部署metaDB,即OCP、数据库节点、OBProxy都是一台服务器OCP 资源规划为20台主机预检查无异常部署中,等待部署完成,记好账号密码{lamp/}三、OCP云平台使用1、登录OCP云平台http://192.168.4.100:8080看到OCP平台初始化失败查看异常为netstat: 未找到命令{message type="info" content="注意,所有OB主机都需要netstat,通过yum安装"/}yum install net-tools -y所有OB主机都需要netstat!全部安装一遍点击重启,执行成功OCP部署成功2、OCP操作流程添加主机-新建集群-创建租户-创建用户-创建OBProxy集群3、添加作为OBProxy集群和OBserver的主机192.168.4.102-109主机标准化分为OBProxy和OceanBase,等待标准化完成OBProxy标准化无异常但也需要修复一下,OceanBase标准化有8个异常,都需要修复修复检查透明大页 echo never > /sys/kernel/mm/transparent_hugepage/enabled 生效 chmod +x /etc/rc.d/rc.local 添加到开机启动 vi /etc/rc.d/rc.local echo never > /sys/kernel/mm/transparent_hugepage/enabled 安装python2.7 yum install python2 -y 禁用swap分区 swapoff -a 删除swap分区 /etc/fstab 安装软件 yum -y install net-tools mtr tar binutils bind-utils curl nc iproute 添加admin用户 groupadd -g 500 admin useradd -m -u 500 -g 500 -s /bin/bash admin id admin 关闭selinux 检查ulimit信息 /etc/security/limits.d/99-oceanbase_limits.conf root soft nofile 655350 root hard nofile 655350 admin soft nofile 655350 admin hard nofile 655350 admin soft stack 10240 admin hard stack 10240 admin soft nproc 655360 admin hard nproc 655360 admin soft core unlimited admin hard core unlimited 检查 clocksource 信息 echo tsc > /sys/devices/system/clocksource/clocksource0/current_clocksource 时间同步 调整端口范围,保留端口 sudo sysctl net.ipv4.ip_local_port_range vi /etc/sysctl.conf net.ipv4.ip_local_port_range = 3500 65535 net.ipv4.ip_local_reserved_ports = 62881-63881 生效 sudo sysctl -p python2软连接到python sudo ln -sf /usr/bin/python2 /usr/bin/python 创建软件目录 mkdir /data/log1 -p mkdir /data/1 -p 重新检查,修复完成4、新建集群新建tntob集群,3zone,每zone 2台主机,由于是实验集群,我没有开启cgroup创建中安装完成5、创建租户创建zabbix6租户Unit规格选择S1并允许所有IP访问创建完成6、创建用户在zabbix6租户中创建用户zabbixdb,先不用创建数据库,一会直接导入一个数据库7、创建OBProxy集群创建tntproxy集群,加入102、103两台主机{message type="info" content="注意:102、103都可以访问集群,而访问地址,一般指的是负载均衡设备的VIP地址,暂不讨论,这里访问地址先填写102"/}创建完成连接到tntob集群8、连接测试使用adminer登陆测试一下连接参数 mysql -h192.168.4.102 -P2883 -uroot@zabbix6#tntob -p登录成功OceanBase分布式数据库集群部署完毕{lamp/}四、OMS迁移服务部署zabbix6数据迁移OMS文档https://www.oceanbase.com/docs/oms-cn1、创建oms租户创建oms租户作为OMS迁移服务的元数据库,需要使用租户的root用户2、安装OMS迁移服务下载软件包 oms_4.2.8-ce.tar.gz 上传到tntoms主机https://www.oceanbase.com/softwarecenter安装dockeryum install -y yum-utils #阿里云加速源 yum-config-manager --add-repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo yum install docker-ce docker-ce-cli containerd.io启动dockersystemctl enable --now docker导入镜像docker load -i oms_4.2.8-ce.tar.gz查看镜像名docker images REPOSITORY TAG IMAGE ID CREATED SIZE reg.docker.alibaba-inc.com/oceanbase/oms feature_4.2.8_ce d56598287295 7 weeks ago 10.9GB 获取部署脚本sudo docker run -d --net host --name oms-config-tool reg.docker.alibaba-inc.com/oceanbase/oms:feature_4.2.8_ce bash && sudo docker cp oms-config-tool:/root/docker_remote_deploy.sh . && sudo docker rm -f oms-config-tool 启动部署mkdir /oms bash docker_remote_deploy.sh -o /oms -i 192.168.4.101 -d reg.docker.alibaba-inc.com/oceanbase/oms:feature_4.2.8_ce 安装中 ****CPU**** CPU_Name(System_Name): Intel(R) Xeon(R) Silver 4309Y CPU @ 2.80GHz Total_physical_CPU: 8 Total_core_num: 8 *****Memory****** Total_Mem: 32915048 KB Total_Mem: 31 G *****Disk****** Total_disk_avail: 954 G 提示:输入 <Control-C> 可退出部署 请选择部署模式: ●单地域单节点 单地域多节点 多地域 您选择的部署模式是:单地域单节点部署模式 请选择您所需要进行的任务: ●无配置文件,全新部署 OMS,从生成配置文件开始 已通过脚本[-c]选项传入参考配置文件,基于参考配置文件开始配置 开始配置元信息库,可以是 MySQL 或 OceanBase 数据库 MySQL 租户 (元信息库用于存储 OMS 运行时元数据信息) 请输入元信息数据库 IP:192.168.4.102 请输入元信息数据库端口:2883 请输入元信息数据库用户名:root@oms#tntob 请输入元信息数据库密码:*********************** 请为 OMS 元数据库设置前缀 (示例:当前缀设置为 oms 时,最终库名分别为 oms_rm/oms_cm/oms_cm_hb): 您的元信息库配置如下: { "drc_cm_db": "_cm", "drc_cm_heartbeat_db": "_cm_hb", "drc_rm_db": "_rm", "init_db": "true", "oms_meta_host": "192.168.4.102", "oms_meta_password": "9cb;CcrN1C3f,Xlub)rx{(#", "oms_meta_port": "2883", "oms_meta_user": "root@oms#tntob" } [y/n] 请确认配置信息[y]y 您选择的部署模式为单地域单节点部署模式 [y/n] 是否自定义组件端口号,并配置相关参数?[n]n [y/n] 获取到您的默认 IP 地址:192.168.4.101,请确认是否需要更改?[n]n 您的 OMS 集群配置如下: { "cm_is_default": true, "cm_location": 0, "cm_nodes": [ "192.168.4.101" ], "cm_region": "default", "cm_region_cn": "默认地域", "cm_server_port": "8088", "cm_url": "http://192.168.4.101:8088", "ghana_server_port": "8090", "nginx_server_port": "8089", "sshd_server_port": "2023", "supervisor_server_port": "9000" } [y/n] 请确认配置信息[y]y [y/n] 您是否需要对 OMS 历史数据进行监控?[n]n [y/n] 是否需要开启 OMS 审计日志功能,并将审计日志写入 SLS 服务?[n]n 已加载您的所有配置项,并校验通过。 您的配置如下: { "apsara_audit_enable": "false", "apsara_audit_sls_access_key": "", "apsara_audit_sls_access_secret": "", "apsara_audit_sls_endpoint": "", "apsara_audit_sls_ops_site_topic": "", "apsara_audit_sls_user_site_topic": "", "cm_is_default": true, "cm_location": "0", "cm_nodes": [ "192.168.4.101" ], "cm_region": "default", "cm_region_cn": "默认地域", "cm_server_port": "8088", "cm_url": "http://192.168.4.101:8088", "drc_cm_db": "_cm", "drc_cm_heartbeat_db": "_cm_hb", "drc_rm_db": "_rm", "ghana_server_port": "8090", "init_db": "true", "nginx_server_port": "8089", "oms_meta_host": "192.168.4.102", "oms_meta_password": "9cb;CcrN1C3f,Xlub)rx{(#", "oms_meta_port": "2883", "oms_meta_user": "root@oms#tntob", "sshd_server_port": "2023", "supervisor_server_port": "9000", "tsdb_enabled": "false", "tsdb_password": "", "tsdb_service": "", "tsdb_url": "", "tsdb_username": "" } [y/n] 您是否需要重新配置?[n]n 您是需要在当前执行的机器上 接下来 OMS 需要在节点 ['192.168.4.101'] 上依次执行部署脚本。 请输入节点 192.168.4.101 上预备部署 OMS 的挂载目录:[/oms/]/oms/ 请您确认以下内容: [y/n] 部署 OMS 的 [镜像名/IMAGE-ID] 是:reg.docker.alibaba-inc.com/oceanbase/oms:feature_4.2.8_ce ,请确认是否正确。[y]y [y/n] 是否需要在 OMS 容器中挂载 HTTPS 证书?[n]n [y/n] 192.168.4.101 节点下的配置文件 config.yaml 将写在这个路径:/oms/ 下可以吗?[y]y ....... -------------------------------------------------------------------------------- # 【结束】全部初始化步骤执行成功 -------------------------------------------------------------------------------- 登录控制台,首次登陆设置密码http://192.168.4.101:8089/3、zabbix6安装查看王工zabbix6文章快速部署,部署完成后迁移到OceanBase集群https://90apt.com/2982安装完成4、导出zabbix6数据库结构使用adminer导出数据库结构,不包括数据adminer安装见后面1Panel部分使用adminer导入到zabbix租户中5、OMS全量迁移在OCP中给zabbixuser用户赋予zabbix数据库全部权限添加双方数据源配置迁移任务启动任务迁移完成,进行切换6、zabbix6切换数据库,重启服务、查看日志配置文件修改/etc/zabbix/web/zabbix.conf.php<?php // Zabbix GUI configuration file. $DB['TYPE'] = 'MYSQL'; $DB['SERVER'] = '192.168.4.102'; $DB['PORT'] = '2883'; $DB['DATABASE'] = 'zabbix'; $DB['USER'] = 'zabbixuser@zabbix6#tntob'; $DB['PASSWORD'] = 'r*h(c^rLst8F'; /etc/zabbix/zabbix_server.confDBHost=192.168.4.102 DBName=zabbix DBUser=zabbixuser@zabbix6#tntob DBPassword=r*h(c^rLst8F DBPort=2883重启zabbix服务 systemctl restart zabbix-server查看日志是否有异常/var/log/zabbix/zabbix_server.logUnable to start Zabbix server due to unsupported MySQL database version (5.06.25).修改OBPorxy数据版本,修改为8.0.0再次重启zabbix服务查看日志,无异常zabbix功能正常,采集正常{lamp/}五、1Panel面板minio S3备份还原计划1、安装docker安装dockeryum install -y yum-utils #阿里云加速源 yum-config-manager --add-repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo yum install docker-ce docker-ce-cli containerd.io启动dockersystemctl enable --now docker2、安装1Panel面板curl -sSL https://resource.fit2cloud.com/1panel/package/quick_start.sh -o quick_start.sh && sh quick_start.sh安装adminer web数据库管理工具支持MySQL、MariaDB、 SQLite、PostgreSQL、Oracle (beta)、MS SQL3、安装minio,配置S3存储登录1Panel面板安装minio登录minio创建Bucket创建Access Keys4、配置备份计划创建zabbix6租户备份策略存储目录为Bucket名称访问域名为API的URL http://192.168.4.111:9000在填入AK、SK,点击测试即可立即备份备份完成5、进行还原测试误删数据库由于王工上年纪老眼昏花,不小心删除了zabbix数据库,不稳啦!zabbix崩溃进行租户恢复恢复完成创建了新的租户,将原租户改名,新租户改为原来的名,这样业务就不用动了业务恢复了,王工又稳啦!{lamp/}六、集群、租户扩缩容1、集群扩容添加主机-集群管理-添加OBServer、新增Zone添加主机OCP云平台-主机-添加主机主机还是要按之前标准化进行环境修复,修复好再添加再次进行标准化OCP云平台-集群-概览-添加OBServer一段时间后部署模式变为集群 (3-3-3)新增Zone与之相同2、集群缩容https://www.oceanbase.com/docs/common-oceanbase-database-cn-1000000002013120删除OBServer时自动进行Unit迁出完成缩容我这边删除114 115 116三台主机批量删除删除中缩容完成3、租户扩容进入租户修改UnitOCP云平台-租户-概览-修改Unit如,将配置修改为S2,Unit修改为2扩容成功4、租户缩容如,将配置修改为S1,Unit修改为1缩容完成{lamp/}七、ODC开发者中心OceanBase 开发者中心(OceanBase Developer Center,ODC)是开源的企业级数据库协同开发工具,有桌面版、Web 版两种产品形态。 ODC Web 版提供了个人空间和团队空间两种工作模式。个人空间适合个人开发者使用,为您在浏览器端提供桌面版的体验;团队空间适合开发者和 DBA 协同使用,既是开发工具也是管控协同平台。 ODC 的代码维护在 Github,单击查看详情,加入 ODC 开源社区,一起创造 开发者和 DBA 喜爱的数据库协同开发工具。https://www.oceanbase.com/docs/odc{message type="info" content="注意:按官方教程你很可能装不上,还是看我的吧"/}1、下载OceanBase 开发者中心web镜像上传到OMS主机,我将ODC安装在OMS主机,ODC为docker镜像https://www.oceanbase.com/softwarecenter2、为ODC创建一个mysql租户并创建一个数据库创建tntodc租户 tntodc数据库 root用户{message type="info" content="注意:数据库用户我测试用普通用户无法部署ODC,需要root用户"/}3、加载镜像gunzip -c obodc4.3.3-bp2.tar.gz | docker load查看镜像docker images REPOSITORY TAG IMAGE ID CREATED SIZE reg.docker.alibaba-inc.com/oceanbase/oms feature_4.2.8_ce d56598287295 7 weeks ago 10.9GB oceanbase/odc 4.3.3_bp2 98a74ab3fbe1 7 weeks ago 1.75GB 4、创建安装脚本odcinstall.sh#!/usr/bin/env bash mkdir -p /tntodc/log/odc mkdir -p /tntodc/data/odc docker run -v /tntodc/log/odc:/opt/odc/log -v /tntodc/data/odc:/opt/odc/data \ -d -i -p 8989:8989 --cpu-period 100000 --cpu-quota 400000 --memory 8G --name "obodc" \ -e "DATABASE_HOST=192.168.4.102" \ -e "DATABASE_PORT=2883" \ -e "DATABASE_USERNAME=root@tntodc#tntob" \ -e "DATABASE_PASSWORD=78ABcd##123" \ -e "DATABASE_NAME=tntodc" \ -e "ODC_ADMIN_INITIAL_PASSWORD=78ABcd##123" \ oceanbase/odc:4.3.3_bp2 注意Shell 环境下,字符串中包含 !、$ 等特殊字符时,变量值需要使用单引号。例如:DATABASE_PASSWORD='11111!'。参数 ODC_ADMIN_INITIAL_PASSWORD 用于指定 ODC 管理员账号的初始密码。设置的初始密码需要须满足以下条件:至少 2 个数字。至少 2 个大写字母。至少 2 个小写字母。至少 2 个特殊字符,特殊字符的范围为 ._+@#$%。不包含空格和其他特殊字符,长度为 8-32。{lamp/}5、安装bash odcinstall.sh6、登录成功八、OBProxy集群keepalived高可用主备VIP部署keepalived介绍请看王工其他文章1、安装keepalived两台OBProxy主机分别安装keepalivedyum install -y keepalived2、配置keepalived两台OBProxy主机分别创建Proxy存活检测脚本vi /etc/keepalived/check_obproxy.sh#!/bin/bash # 检查2883端口是否有监听 if ss -tuln | grep -q ':2883\b'; then exit 0 # 检测成功,返回0 else exit 1 # 检测失败,返回1 fitntproxy1配置执行权限chmod +x /etc/keepalived/check_obproxy.sh配置文件vi /etc/keepalived/keepalived.conf! Configuration File for keepalived global_defs { router_id keepalived1 #只是名字而已,辅节点改为keepalived2(两个名字一定不能一样) } vrrp_script check_obproxy { script "/etc/keepalived/check_obproxy.sh" interval 2 #每2秒执行一次 } vrrp_instance VI_1 { state MASTER #定义主还是备,备用的话写backup interface ens192 #VIP绑定接口 virtual_router_id 66 #整个集群的调度器一致(在同一个集群) priority 100 #(优先权)back改为50(50一间隔) advert_int 1 #发包 authentication { auth_type PASS #主备节点认证 auth_pass 1111 } unicast_src_ip 192.168.4.102 #本机ip unicast_peer { 192.168.4.103 #其他机器ip,可多个 } virtual_ipaddress { 192.168.4.99/24 #VIP(自己网段的) } track_script { check_obproxy } }tntproxy2配置执行权限chmod +x /etc/keepalived/check_obproxy.sh配置文件vi /etc/keepalived/keepalived.conf! Configuration File for keepalived global_defs { router_id keepalived2 } vrrp_script check_obproxy { script "/etc/keepalived/check_obproxy.sh" interval 2 #每2秒执行一次 } vrrp_instance VI_1 { state BACKUP #设置为backup interface ens192 nopreempt #设置到back上面,不抢占资源 virtual_router_id 66 priority 50 #辅助改为50 advert_int 1 #检测间隔1s authentication { auth_type PASS auth_pass 1111 #认证类型和密码主备一样,要不然无法互相认证 } unicast_src_ip 192.168.4.103 #本机ip unicast_peer { 192.168.4.102 #其他机器ip,可多个 } virtual_ipaddress { 192.168.4.99/24 #抢占的VIP也一样 } track_script { check_obproxy } }3、启动服务systemctl enable --now keepalived4、高可用测试将zabbix数据库指向VIP,连续ping 192.168.4.99,并查看zabbix服务状态obproxy1关机,查看ping和zabbix状态正常,业务几乎无感来自 192.168.4.99 的回复: 字节=32 时间=15ms TTL=63 来自 192.168.4.99 的回复: 字节=32 时间=21ms TTL=63 来自 192.168.4.99 的回复: 字节=32 时间=28ms TTL=63 来自 192.168.4.99 的回复: 字节=32 时间=2ms TTL=63 来自 192.168.4.99 的回复: 字节=32 时间=49ms TTL=63 来自 192.168.4.99 的回复: 字节=32 时间=1ms TTL=63obproxy2获得VIPinet 192.168.4.103/24 brd 192.168.4.255 scope global noprefixroute ens192 valid_lft forever preferred_lft forever inet 192.168.4.99/24 scope global secondary ens192 valid_lft forever preferred_lft forever obproxy1开机,obproxy服务启动成功后,自动抢回VIP inet 192.168.4.102/24 brd 192.168.4.255 scope global noprefixroute ens192 valid_lft forever preferred_lft forever inet 192.168.4.99/24 scope global secondary ens192 valid_lft forever preferred_lft forever 5、测试结论高可用正常,VIP正常九、故障处理1、任意一台OBServer主机故障关机1台OBServer主机,集群无影响,一段时间后Zone内另一台主机接管此OBServer功能开机此OBServer,一段时间后集群自动修复此主机并上线2、{lamp/}十、不停机滚动升级V4.3.5_CE_BP1_HF1版本信息发布时间:2025 年 04 月 30 日下载数据库rpm安装包oceanbase-ce-4.3.5.1-101010042025042417.el8.x86_64.rpmhttps://www.oceanbase.com/softwarecenter登录OCP平台,进入集群,升级版本上传安装包升级路经确认提示 集群升级缺少社区版依赖包:[oceanbase-ce-utils-4.3.5.1-101010042025042417.x86_64, oceanbase-ce-libs-4.3.5.1-101010042025042417.x86_64]下载并上传oceanbase-ce-libs-4.3.5.1-101010042025042417.el8.x86_64.rpmoceanbase-ce-utils-4.3.5.1-101010042025042417.el8.x86_64.rpm升级中升级前版本升级中如果出现任务失败,根据情况可点击重试,我点了四五次就完成了升级后版本,升级完成,升级过程中业务无感知{lamp/}十一、总结太强了 -

-